区分抑郁和自杀行为,机器学习是怎么做到的?

机器看起来是冰冷的,但也是可以是有温度的。人工智能可以通过情感模型,对一些人类只能感性判断的其他人的情绪和行为,进行精准地判断。

情感是人类社会的基本要素。

你仔细想想:凡是拥有分析价值的事物都受到人类行为的影响。

心怀不满的员工可能会无视尽职调查,或者泄露信息或者恶意破坏公司数据,造成网络攻击;股票市场取决于经济环境,而经济环境本身取决于大众行为。

众所周知,在人类交流沟通中,我们的言语仅能传递7%的信息,而其余93%均由面部表情和其他非言语行为传递。心理学和行为经济学均致力于这一领域的研究。

如果能够有效衡量和分析情绪,便能为社会带来巨大改善。

加利福尼亚大学旧金山分校一位心理学教授保罗·艾克曼著有《说谎:如何识破政界、军界、商界及婚姻中的骗局》,在这本书中,他描述了心理学家:如何通过阅读面部表情,发现病人试图掩盖的自杀倾向?

听起来有点像人脸识别模型所做的工作。

- 神经映射怎么样?

- 我们能否有效地从神经冲动中映射情绪状态?

- 能否改善认知能力,甚至是情商和有效沟通呢?

现有的大量非结构化数据可以解决世界上存在的许多问题。

不过正如每个数据科学问题一样,我们需要深入情感建模这一核心挑战:

- 如何构建问题?我们的模型类别应该是什么?优化的目的是什么?

- 我们应该收集哪些数据?我们寻找的是什么样的相关性?应该重点关注哪些方面?

- 访问此类数据是否存在问题?对于获取情感,社会和文化上的观点是什么样的?需要维护哪些隐私法规?数据安全问题呢?

卫生保健

向医生说谎的患者并不少见。

人们和医生面对面的时间很少,再加上尴尬,加剧了人们对医生的不信任。

一个数字健康平台ZocDoc显示:因为尴尬或害怕受到评判,近一半(46%)的美国人没有向医生坦诚健康问题;约三分之一(27%)的人表示自己隐瞒了细节,因为他们找不到合适的机会或是预约时长不够;还有一部分人表示(32%)医生没有提出任何问题或询问他们是否受到任何问题困扰。

这主要对自杀产生了影响。

据世界卫生组织(WHO)称:每年有多达80万人死于自杀,其中60%面临严重抑郁症。尽管抑郁症患者自杀风险较高,但抑郁自杀和抑郁的个体之间的差异并不容易察觉到。

蒂娜·扎伊迪在她的博客中描述:机器学习通过面部表情来区分抑郁和自杀行为。

这就意味着:一名能够对风险因素进行深入评估的自杀专家,预测患者未来的自杀意图和行为的准确度,与一个对病人一无所知的人相当。

这和扔硬币判断没什么区别。

虽然使用监控学习模型识别面部表情的技术仍在开发中,但该领域已经展现出了很多前景。

通过向量机分析得出的真笑(上图)和假笑(下图)结果帮助检测自杀风险(来源:自杀意图的面部行为指标研究,Laksanaet等)。

南加州大学、卡内基梅隆大学和辛辛那提儿童医院医学中心的科学家,合作撰写的一份报告对利用非言语面部行为检测自杀风险进行了调查研究。

研究声称:已发现一种区分抑郁症和自杀症患者的方法。

他们利用向量机,发现面部行为描述符,例如:自杀和非自杀组之间微笑(涉及眼轮匝肌的收缩的微笑,即“真笑”)的程度(百分比)差异具有统计学上的意义。

认知能力

认知能力是一种大脑技能,任何任务都离不开认知能力。

认知能力更多地与和我们学习、记忆、解决问题和关注的机制相关,而不是实际的知识。

人们都希望提高认知能力,试问,谁不想改善记忆力、迅速掌握晦涩的抽象概念、 更清楚地“看到事物之间的联系”?

苹果应用商店中的Elevate软件

目前,有一些应用程序可以帮助我们培养认知能力。

例如:Elevate,它包含训练大脑的游戏,用户可以选择适合自己的难度,以提高心算、阅读和批判性思维能力。

最佳认知功能的价值无需赘言。

我们一直在突破5种感官的界限,以便更深入地了解我们周围的世界,例如:在图像识别领域,通过观察远远超出RGB光谱的变量,人工智能可以比人类看到更多的东西,这又有助于我们超越自己的视觉限制。

但是,当时我们可以实现虚拟现实等技术,为何还要给自己设限,使用2D屏幕来显示3D对象?

Nanome公司开发出了用于分析抽象分子结构的增强现实技术

增强现实让我们仿佛瞬移到另一个世界。

这涉及到计算材料科学和生物学两个领域。可视化复杂的分子结构,对许多研究人员来说是一个挑战。

Nanome公司利用增强现实技术可视化这些复杂的结构,而且已经有很多创业公司在解剖学领域使用增强现实技术来培训外科医生。

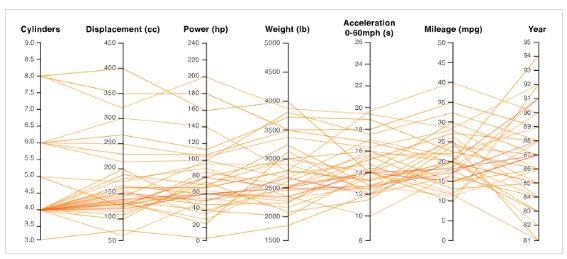

数据可视化技术Parallel Coordinate将七维空间可视化

数据可视化和降维算法这些新用语随着技术产生流行开来。

这些技术可以帮助我们更好地体验周围世界,例如:我们有平行坐标,允许我们在高维空间中进行可视化和过滤,而t-SNE可以将复杂空间分解为2D或3D空间,之后对其进行可视化。

情绪智力

情绪智力是一种能力,指:人能够意识到、控制和表达自己的情绪,怀着同理心理智处理人际关系的能力。

所有人都会感受到情绪,但是只有少数人能够在情绪产生时准确识别它们。这可能是缺乏自我意识,或是我们表达情感的词汇过于贫瘠造成的。

很多时候,我们甚至不知道我们想要什么。我们努力以特定的方式与周围的人产生联系,或是消费特定的产品,这样做的时候,我们会感受到一种难以描述的独特情感。

我们感受的不仅仅是快乐、悲伤、愤怒、焦虑或恐惧,我们的情绪是这些情感的复杂组合。理解我们自己,以及周围人的情绪的能力,对于情绪健康和维持良好关系至关重要。

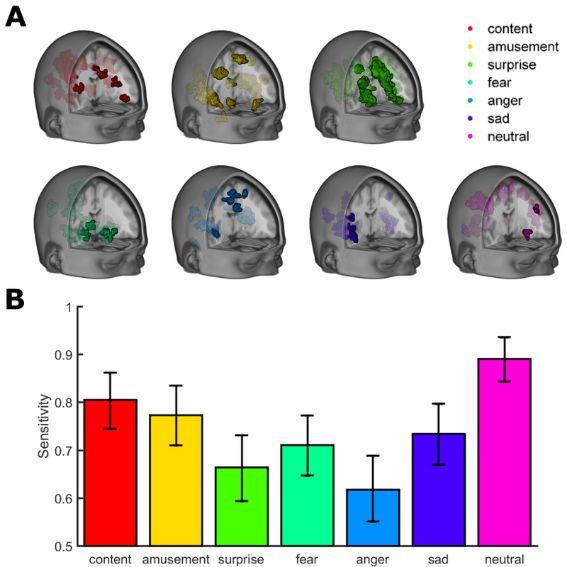

颜色对应情绪(从左至右)分别为:满足、愉快、惊讶、恐惧、愤怒、悲伤、平静。

分布式的大脑活动模式预测了fMRI扫描检测到的抽象情感(上图)和灵敏度范围(下图)(来源:解读人脑中的自发情绪状态,Kragal等)

通过神经映射领域的创新,我们将更好地了解我们作为人类的身份,以及自己的各种情绪状态。

监督学习已经发现了一些共同的情感。通过对脑电波进行无监督学习,我们可以更好地理解复杂的情绪模式,例如:简单的异常值检测算法可能会揭示新的情绪模式,或是重要的情绪压力因素来引起注意。

这些研究可以找到创新的方法改善情绪智力。

准确阅读微表情可以促进商业谈判(来源:TED演讲:肢体语言和微表情如何预测成功 – 帕特里克和卡西亚·维兹沃斯基)

用于防止自杀的监督图像识别模型也可以让人们识别交谈对方的情感。

这里有一个关于微表情的TED演讲,它展示了:如何通过阅读微表情在商务谈判时预估理想价格。

它还提到:那些擅长阅读微表情的销售人员,比不擅长的人销售额高出20%。如果想获得这20%的优势,可以买一副能识别微表情的眼镜。

情绪智力既包括理解我们自己的情绪,也包括善于捕捉周围人的情绪。通过深入研究我们的情绪状态,我们可以解锁之前从未体验过的新情绪。如果得到合理运用,人工智能可以帮助我们和身边的人建立有意义的联系。

体验与想象

想象力是一种能力,帮助我们形成五感无法感知的新观点、图像和概念。

人工智能会对我们的经验和想象力产生影响:改善我们的认知能力,提高情商。

简而言之,一旦拥有了更丰富的认知能力和情感智能模式,我们将能感受到今日一般人无法想象的思想和观点。

牛津大学的一位哲学系教授尼克·博斯特罗姆写过一篇论文,题为“长大后,我为何想成为一名新人类”。

这篇文章描述了新型体验模式如何增强我们的经验和想象力,让我们假设现有的经验模式在空间X中表示。

10年后的经验模式在空间Y中表示,空间Y将远大于空间X,这个未来主义的空间Y除了传统意义上的快乐,悲伤和疯狂之外,还会包含新的情感。

在空间 Y中,甚至可以让我们理解抽象思想,表达出我们一度想表达却无法表达的事物。每个人都能以各种方式看待世界,我们的想象力甚至连梵高都难以企及。

空间Y实际上可以开启一个充满无限可能的新世界,远超我们的想象。未来,人们将会拥有更多元的思考、更丰富的感受、更充实的体验。

交流沟通

人一旦缺乏情商,便很难与他人接触。缺乏情商的人常常感到被人误会,因为他们没有以大家能够理解的方式传达信息。即便是情商高的人也知道他们无法完美地表达每一个想法。 未来AI有望通过增强自我表达来改变这一现状。

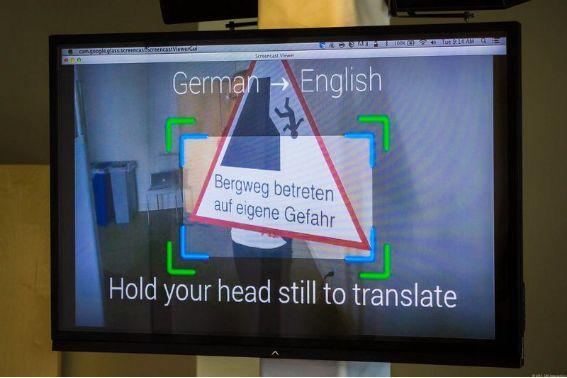

谷歌眼镜将德语翻译为英语(来源:谷歌收购Word Lens制造商推动翻译业务)

10年前,我们的大多数通信仅限于手机和电子邮件。当今,我们拥有了视频会议、增强现实和社交媒体上的各种应用程序。

当我们提高我们的认知能力和情商时,我们可以通过更清晰和更浅显的习语来表达自己。

谷歌眼镜可以即时翻译外国文本。在前文我已经提到过谷歌眼镜可以阅读微表情。但是,为什么要将沟通仅限于我们能够“看到”的范围内?

通过向安置在头盔上的传感器发送电脉冲来控制无人机(来源:佛罗里达大学举行独特的“精神控制”无人机比赛)

佛罗里达大学的学生可以使用精神控制无人机。我们甚至可以使用振动的游戏手柄,利用我们的触觉,使马里奥赛车游戏更加逼真。

今天的增强现实仅限于视觉和听觉。在未来,增强现实还会让扩展到味觉、触觉和嗅觉。

除了五感之外,我们对某些情境的情绪反应可能会通过AI的力量进行微调和优化。我们也可以感受非人或超自然角色的情绪,例如:感受艾玛的心碎,或是从口袋妖怪的冒险中体味兴奋。

潜在挑战

尽管我已经阐明人工智能帮助我们能够识别情感,了解自己和周围的人,但我们不能忘记潜在的挑战:

数据安全

世界隐私论坛称,被盗医疗保健凭证的黑市价值约为50美元,相比之下,被盗信用卡信息或社会安全号码仅为1美元。同样,心理健康信息也是非常敏感的个人数据,容易遭到窃取。就像信用卡和健康保险信息一样,和情绪相关的信息也会被黑客盯上,因为这在黑市可以卖到不错的价钱。

政府数据规则

对于任何高度敏感的个人数据,不同的国家或地区都有不同法规。

在美国,医疗保健相关数据需要遵守HIPAA(健康保险流通与责任法案)法规,而与金融应用相关的数据则需要遵守PCI(第三方支付行业)认证。

放眼世界,欧盟制定了GDPR(通用数据保护条例),中国有SAC(中国国家标准化管理委员会)。

道德边界

就像其他新技术一样,获取情绪的信息会遭到社会的疑问和抵触,我们必须直面现实。

医生查看我们的情绪数据,帮助我们改善我们的健康,这无可厚非,但我们绝不希望保险公司也能获得数据,从而借此收取高额保费。

按照这种思路,我们怀疑美国有操纵群众心理来决定投票走向的行为。

然而,道德规范在很大程度上依赖于特定社会中被视为“准则”的事物。如果社会现在无法接受一种事物,未来也不会接受。

虽然数据科学在这一领域的某些方面的应用会让公众感到不舒服,但其他一些应用,如:防止信用欺诈和反洗钱的欺诈分析,以及亚马逊和Netflix等推荐系统的营销分析,都是完全可以接受的。

引入新观念时,社会对此的接受程度很大一部分取决于收集到的数据用来解决怎样的问题。

相关链接:

https://www.kdnuggets.com/2019/02/data-science-mental-development.html

作者:读芯术,微信公众号:读芯术

来源:https://mp.weixin.qq.com/s/cX9-zGJPuINrhr7Uq58o_g

本文由@读芯术 授权发布于人人都是产品经理,未经作者许可,禁止转载

题图来自Unsplash, 基于CC0协议

起点课堂会员权益

起点课堂会员权益

嗨