真不是愚人节新闻:使用下意识时的你,与AI无异

在昨天这个人人都有可能被愚弄的日子,不如我们来换换戏耍的对象,看看机器有没有可能被愚弄欺骗呢?

在人工智能五十年的研发过程中,我们一直在不断尝试着让机器理解人对于世界的认知方式。不管是一直没有实现较大突破的类脑计算,还是模仿人类感知外界机制的人工神经网络,本质上都是对人类行为方式的多种模仿。

当然我们也知道,这些模仿虽然在应用上取得突破,但本质上来看与人类的认知方式还是大相径庭的。

就拿视觉来说,人类对于万事万物的认知来自于综合的感知。以前一阵社交媒体上疯传的《神奇宝贝》大电影来说,人们见到3D版皮卡丘非常惊讶——皮卡丘竟然是有毛的?

其实这就体现了人类非常有趣的一点,建立在综合知识基础之上,人类的五感是相通的,因此可以从有限的信息里进行关联挖掘,对陌生的事物建立起认知。

当我们简单皮卡丘身上茸毛时,我们立刻联想起了那种毛茸茸的手感,认为它像一只大老鼠毫不可爱。

被随意愚弄的机器思维相比之下机器视觉的认知方式就相对孤立,建立分类器后组织层层的神经网络,对图片进行分层处理,分别去辨认图片中是不是一架桥,是不是一只猴子,是不是一棵大树。最后得出的结论是,这张图片97%的几率是一架桥,2%的几率是一只猴子,1%的几率是一棵大树。

对于人类来说,我们可能把猴子看成猩猩,原因是我们自己脑海中的底层知识不足,在认知中分不清猩猩和猴子的概念。但绝不会把桥、猴子、大树这些风马牛不相及的东西混淆一谈。

但对于机器视觉就不一样了,在机器的“眼中”,一切图像都是像素点的排列组合。对于我们来说,猴子和大树的区别是哺乳动物和区别。可对于机器来说,猴子和大树之间只有一个数字分割线而已。

这就导致了机器视觉可以被“针对性”的愚弄,让图像识别输出完全错误的结果,这就是我们常说的对抗生成样本。例如:将一张图片的像素点进行轻微的移动,在人眼中两张图片没有任何区别,可在机器识别逻辑下,却可能让机器把猴子认成大树。

又比如我们曾经介绍过的“迷幻贴纸”——将某一种物体的分类特征高度浓缩成一个很小图案,“粘贴”在其他图片上。图像识别对于结果的输出,是基于几项结果比率的高低。在贴上贴纸之前,图像识别可能明确的分析出图片有98%几率的是一只猴子。但粘贴上高度浓缩特征的贴纸之后,就能立刻改变图像识别的结果。

让人类理解机器思维,或许比想象中更容易

如此看来,虽然机器一直在尝试模仿人类的思维方式,但最终结果还是我们与机器之间彼此无法理解。那么如果换个角度,让人类去学习机器的思维方式呢?

近期约翰霍普金斯大学就做了这样一项实验。

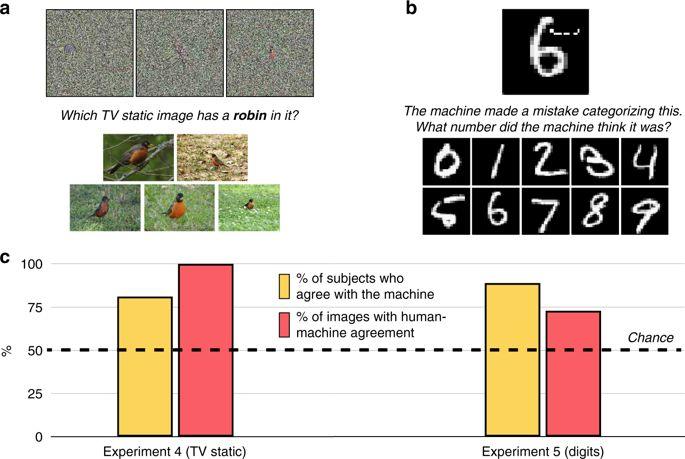

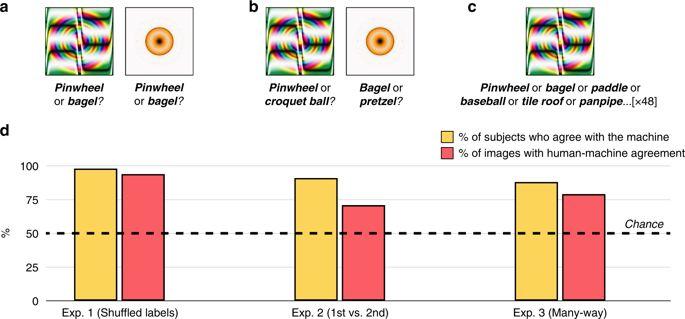

为了弄明白为什么机器能看到人类“看不到”的变化,约翰霍普金斯大学推出了一系列实验,让人类志愿者在图片中找到“机器犯的错误”。

例如给志愿者一张噪点图或看似无意义的花纹,让人类志愿者从中识别辨认图片更像哪一种物体,并将AI给出的结果混淆其中。又比如给人类几个斑驳的数字图案,让人类志愿者选择AI可能将图案误认成了什么错误的数字。

令人震惊的是,在大部分实验中,人类志愿者都凭借着直觉很快辨认出了AI的思维模式。

以上图为例,有81%的人类志愿者都准确的发觉了机器会犯下的错误。在一共48个实验1700位志愿者中,有人们在75%的时间里都选择和机器一样的答案,而只有2%的人从来没有选择过和机器一样的答案。

这个惊人的实验结果告诉我们,即使抛开人类基础的认知逻辑,应用下意识的第一反应,也能够和机器得出相同的结果。看来神经网络黑箱中对于人类经验提炼的深度,或许远超我们想象。

对抗对抗性图像:当人类开始理解机器

这个实验的意义,当然不是为了告诉大家其实我们都是机器人,而是教会了我们如何应对机器视觉可能犯下的错误。在机器视觉认知模式的固有弊端下,很可能会形成很多可供钻空子的漏洞。例如当自动驾驶识别公路上的交通标志时,一个小小贴纸就可能让视觉系统产生错觉,把交通标识识别成突然出现的行人来个急刹车。

为了解决这种可能出现的情况,通过理解机器思维并进行逆向拆解或许是个不错的方法。

从实验中我们可以看出,即使是毫无逻辑的图案和纹理,人类也可以通过联想能力对这些图片进行更高级的认知和处理。实验中人类和机器进入了同样的情景,面对几个分类选项做选择题。而这种分类选择或许就是让机器陷入错误的关键。

另外一点则是,人类可以很清楚的识别出对抗性图像。例如:故意斑驳让人难以辨认数字图案,以及特征十分明显的花哨贴纸。那么说明这些对抗性的图案也拥有自己的“对抗性特征”。

虽然面对这种情况,最理想的方式是放弃卷积神经网络,应用认知计算真正让人工智能建立在一个更完整的世界观上进行识别。但在认知计算获得突破之前,我们或许可以寻找一些替代性的解决方案。

例如:我们可以在一些安防、自动驾驶等等关键场合之中,特意生成对抗性样本让人类进行标注,在汽车、行人这些常规分类中多出一个“对抗样本”分类,让卷积神经网络可以识别出来这些捣乱的图案。

对于那种动几个像素点就可以改变机器认知的情况,很有可能出现在数据流通途中的压缩产生的失误,我们可以寻找使得机器认知结果改变的压缩规律,反向从源头组织失误的发生。

在愚人节这个日子里,发现“人类与机器有着十分相近的思维模式”这一新闻,听起来似乎像个笑话。但或许我们引以为傲的“人类意识”,根本并没有那么复杂,最终会与机器思维以一种出乎意料的方式相遇。

但在相遇之前,我们还是应该用人类思维与机器人思维之间的相似性,来解决现实生活中的问题。

作者:脑极体,微信公众号:脑极体

本文由 @脑极体 原创发布于人人都是产品经理。未经许可,禁止转载。

题图来源于 Unsplash,基于CC0协议

起点课堂会员权益

起点课堂会员权益

你如果了解神经网络算法,也了解人的认知神经的一些研究,那么对于“人类与机器有着十分相近的思维模式”你一点也不会感到惊讶。因为神经网络算法和人的神经认知原理本来就是一样的!