谷歌内部文件遭泄露|我们没有壁垒,OpenAI也没有

今日,海外AI圈开始流传一篇文章,文章详细介绍了最近在Discord群组由匿名人士泄露的一份Google内部的文件,该文件声称,开源AI将击败谷歌和OpenAI,同时谷歌声称:“我们没有护城河,OpenAI也没有”。这篇文章在海外引起了热议,有人认同,也有人反对,本文作者借助GPT-4快速翻译了这篇文章,一起来看一下吧。

就在今天美国时间早上,海外AI圈开始流传一篇SemiAnalysis博客的文章,这篇文章详细介绍了最近在Discord群组由匿名人士泄露的一份Google内部的文件,该文件声称,开源AI将击败谷歌和OpenAI,同时谷歌声称:“我们没有护城河,OpenAI也没有”。一石激起千层浪,这篇文章在海外引发了热议,有人认同,也有人反对。笔者在此借助GPT-4快速翻译了这篇文章,希望能够给大家也带来最新的思考和启发。

来自SemiAnalysis博客的声明翻译:

以下内容源自最近泄露的一份文件,由一位匿名人士在一个公共Discord服务器上分享,并已获得转载许可。文件来自谷歌内部的一名研究员,我们已核实了其真实性。所作的唯一修改是调整格式和删除指向内部网页的链接。这份文件仅代表谷歌员工的观点,而非整个公司。我们并不同意以下观点,我们咨询的其他研究人员也并不认同,但我们将为订阅者撰写一篇单独的文章发表我们的观点。我们只是作为一个平台来分享这份引起广泛关注的文件。

01 我们没有护城河,OpenAI也没有

我们一直在关注OpenAI的动向。谁将达到下一个里程碑?下一步将会是什么?然而,不得不承认的事实是,我们无法赢得这场竞赛,OpenAI也同样如此。在我们争执的同时,第三方力量悄然取得了优势。

我当然是在谈论开源了。简而言之,他们正在超越我们。我们认为的“重大开放性问题”如今已经解决,并投入人们的使用。以下仅列举一些:

- 手机上的LLMs:人们在Pixel 6手机上以每秒5个token的速度运行基础模型。

- 可扩展的个人AI:你可以在一个晚上用笔记本电脑微调个性化AI。

- 负责任的发布:这一点并不是“解决”了,而是“消除”了。整个互联网上有许多没有任何限制的艺术模型网站,文本也紧随其后。

多模态:当前多模态ScienceQA的最新技术水平在一个小时内就得到了训练。

虽然我们的模型在质量上仍然略占优势,但差距正在惊人的速度缩小。开源模型更快、更可定制、更具隐私性,性能更强。他们用100美元和130亿参数做到了我们在1000万美元和5400亿参数下仍在努力的事情。而且他们只用了几周时间,而不是几个月。这对我们意味着:

- 我们没有秘密武器。我们最好的希望是向谷歌以外的其他人学习并与之合作。我们应该优先考虑支持第三方集成。

- 当有免费、无限制的替代品质量相当时,人们不会为受限制的模型付费。我们应该考虑我们真正的价值在哪里。

- 庞大的模型拖慢了我们的步伐。从长远来看,最好的模型是那些可以快速迭代的模型。既然我们知道在参数少于200亿的情况下有什么可能,我们应该更关注小型变体。

02 发生了什么

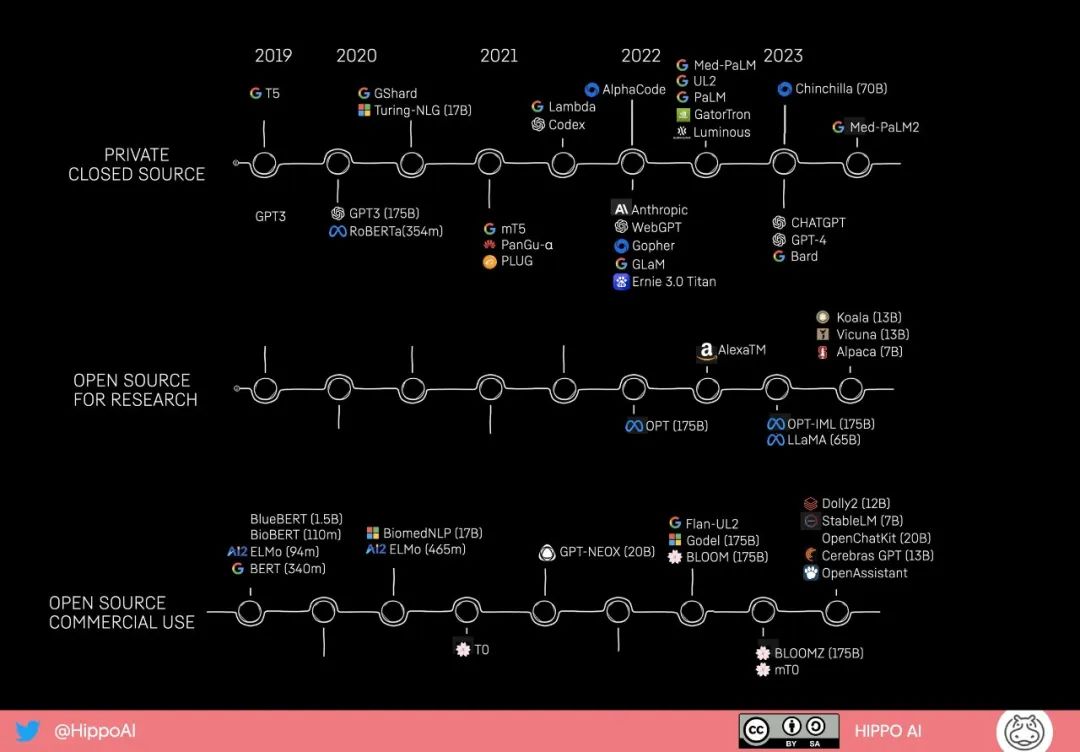

三月初,开源社区得到了他们的第一个真正有能力的基础模型,因为Meta的LLaMA被泄露给了公众。它没有指令或对话调整,也没有RLHF。然而,社区立即认识到了他们所得到的东西的重要性。随后迅速涌现出大量创新,每隔几天就有重大发展(详见《时间线》)。仅仅一个月后,我们看到了具有指令调整(instruction tuning)、量化(quantization)、质量改进(quality improvements)、人类评估(human evals)、多模态、RLHF等功能的变体,其中许多变体是相互依赖的。

最重要的是,他们已经在很大程度上解决了规模问题,使得任何人都可以参与其中。许多新想法来自普通人。训练和实验的门槛已经从一个大型研究机构的全部产出降低到一个人、一个晚上和一台性能强大的笔记本电脑。

03 为什么我们本可以预见到

在很多方面,这对于任何人来说都不应该是一个惊喜。当前开源LLM的复兴紧随着图像生成领域的复兴之后。社区对这两者之间的相似之处并不陌生,许多人将这称为LLM的“Stable Diffusion Moment”。在这两种情况下,低成本的公共参与得以实现,因为有一种称为低秩适应(Low rank adaptation,LoRA)的大大降低成本的微调机制,结合了规模方面的重大突破(图像合成的Latent Diffusion,LLM的Chinchilla)。在这两种情况下,获得足够高质量模型的访问引发了来自世界各地个人和机构的大量想法和迭代。在这两种情况下,这些迅速超过了大型参与者。

在图像生成领域,这些贡献起到了关键作用,使Stable Diffusion走上了与Dall-E不同的道路。拥有开放模型导致了产品整合、市场、用户界面和创新,而这些对于Dall-E来说并未发生。

效果是明显的:在文化影响方面迅速占据主导地位,与之相比,OpenAI的解决方案变得越来越无关紧要。是否会发生在LLM上同样的事情还有待观察,但总体结构元素是相同的。

04 我们错过了什么

推动开源近期成功的创新直接解决了我们仍在努力应对的问题。更多关注他们的工作可以帮助我们避免重复发明轮子。LoRA是一种我们应该更加关注的非常强大的技术。

LoRA通过将模型更新表示为低秩分解(low-rank factorizations)来工作,从而将更新矩阵的大小减小多达数千倍。这使得模型微调的成本和时间大大减少。在消费者硬件上花几个小时个性化语言模型是一件大事,尤其是对于涉及近乎实时地整合新的、多样化知识的愿景。这项技术的存在在谷歌内部被低估了,尽管它直接影响了我们一些最雄心勃勃的项目。

05 从头开始重新训练模型是困难的途径

使LoRA如此有效的部分原因是它(与其他微调形式一样)是可堆叠的。诸如指令调整之类的改进可以应用,然后在其他贡献者添加对话、推理或工具使用时加以利用。虽然单个微调的秩较低(low rank),但它们的总和不必如此,从而允许随着时间的推移累积对模型进行全秩(full-rank)更新。这意味着随着新的、更好的数据集和任务变得可用,模型可以以较低的成本保持最新状态,而无需支付完整运行的成本。

相比之下,从头开始训练巨型模型不仅会丢弃预训练,还会丢弃已经在顶部进行的迭代改进。在开源世界,这些改进很快就会占据主导地位,使得完全重新训练变得极其昂贵。

我们应该认真思考每个新的应用或想法是否真的需要一个全新的模型。如果我们确实有重大的架构改进,使得无法直接重用模型权重,那么我们应该投资于更具侵略性的蒸馏形式(distillation),以便尽可能保留前一代的能力。

06 从长远来看,如果我们能在小模型上更快地迭代,大型模型并不会更有能力

LoRA更新对于最受欢迎的模型尺寸非常便宜(约100美元)。这意味着几乎任何有想法的人都可以生成一个并将其发布。培训时间少于一天是常态。在这个速度下,这些微调的累积效果很快就能弥补起始尺寸劣势。事实上,从工程师小时的角度来看,这些模型的改进速度远远超过了我们在最大型号上所能做到的,而且最好的模型已经与ChatGPT几乎无法区分。专注于维护地球上一些最大的模型实际上让我们处于劣势。

07 数据质量比数据规模更具可扩展性

许多项目通过在小型、精选数据集上进行训练来节省时间。这表明数据扩展规律具有一定的灵活性。这些数据集的存在源于《数据并非如你所想》一文中的思考线,它们正迅速成为谷歌以外进行训练的标准方式。这些数据集是通过合成方法(例如从现有模型中筛选最佳响应)和从其他项目中收集而来,谷歌在这两者中都不占主导地位。幸运的是,这些高质量数据集是开源的,所以我们可以自由使用。

08 与开源直接竞争是输不起的游戏

近期的进展对我们的商业策略有直接、即时的影响。如果有一个免费的、高质量的、没有限制的替代方案,谁会为带有使用限制的谷歌产品付费?而且我们不应该指望能够迎头赶上。现代互联网之所以依赖开源,是有原因的。开源有一些我们无法复制的显著优势。

09 我们需要他们胜过他们需要我们

保密我们的技术一直是一个脆弱的命题。谷歌的研究人员定期离开公司去其他公司,所以我们可以假设他们知道我们所知道的一切,并将继续这样做,只要这个渠道还在。但在LLM领域的尖端研究变得负担得起的情况下,保持技术竞争优势变得更加困难。全球各地的研究机构在彼此的工作基础上进行建设,以广度优先的方式探索解决方案空间,远超我们自身的能力。我们可以试着紧紧抓住我们的秘密,而外部创新会削弱它们的价值,或者我们可以试着互相学习。

10 与公司相比,个人受许可限制的程度较小

许多创新都是基于Meta泄露的模型权重发生的。虽然这肯定会随着真正的开源模型变得更好而改变,但关键是他们不必等待。法律规定的“个人使用”以及起诉个人的实际困难意味着个人在这些技术炽热时就能获得这些技术。

11 作为自己的客户意味着你了解用例

浏览人们在图像生成领域创建的模型,有大量的创意涌现,从动漫生成器到HDR风景。这些模型由深入特定子类型的人使用和创建,赋予了我们无法企及的知识深度和共鸣。

12 拥有生态系统:让开源为我们服务

矛盾的是,所有这些事情中唯一明确的赢家是Meta。因为泄露的模型是他们的,所以他们实际上获得了相当于整个星球的免费劳动力。由于大部分开源创新都是基于他们的架构进行的,所以没有什么能阻止他们直接将其纳入自己的产品中。拥有生态系统的价值不可估量。谷歌本身在其开源产品(如Chrome和Android)中成功地利用了这一范式。通过拥有创新发生的平台,谷歌巩固了自己作为思想领袖和方向制定者的地位,赢得了塑造比自己更大的想法叙事的能力。

我们对模型的控制越严格,开放替代品就越有吸引力。谷歌和OpenAI都在朝着保留对模型使用方式的严格控制的发布模式做出防御性反应。但这种控制只是虚构的。任何试图将LLMs用于未经批准的目的的人都可以选择自由提供的模型。

谷歌应该在开源社区确立自己的领导地位,通过与更广泛的对话合作,而不是忽略它们,来起到引领作用。这可能意味着采取一些令人不安的步骤,例如发布小型ULM变体的模型权重。这必然意味着放弃对我们模型的一些控制。但这种妥协是不可避免的。我们不能既希望建立创新又控制创新。

13 尾声:OpenAI呢?

所有关于开源的讨论可能让人觉得不公平,因为OpenAI目前的政策是封闭的。如果他们不分享,为什么我们必须分享呢?但事实是,我们已经通过源源不断地被挖走的高级研究人员与他们分享了一切。除非我们遏制这种趋势,否则保密就毫无意义了。最后,OpenAI并不重要。他们在与开源的相对立场上犯了与我们相同的错误,他们保持优势的能力必然受到质疑。开源替代品可以并最终会取代他们,除非他们改变立场。至少在这方面,我们可以先行一步。

14 时间线

2023年2月24日 – LLaMA发布

Meta发布LLaMA,开源代码,但不开源权重。此时,LLaMA尚未进行指令或对话调优。与许多当前模型一样,它是一个相对较小的模型(参数分别为7B、13B、33B和65B),经过相对较长时间的训练,因此与其大小相比具有相当强大的能力。

2023年3月3日 – 不可避免的事情发生了

一周内,LLaMA被泄露给公众。这对社区的影响不可估量。虽然现有许可证阻止了它被用于商业目的,但突然之间任何人都可以尝试进行实验。从此时开始,创新进展迅速。

2023年3月12日 – 语言模型在烤箱上运行

一个多星期后,Artem Andreenko让模型在树莓派上运行。此时,模型运行速度太慢,因为权重必须在内存中分页,实用性不强。尽管如此,这为一系列的模型缩小工作奠定了基础。

2023年3月13日 – 笔记本电脑上的微调

第二天,斯坦福大学发布了Alpaca,为LLaMA增加了指令调优。然而,更重要的是Eric Wang的alpaca-lora仓库,它使用低秩微调在“单个RTX 4090上几小时内”完成了这个训练。

突然之间,任何人都可以微调模型以执行任何操作,这引发了一场关于低成本微调项目的竞争。论文中自豪地描述了他们总共花费了几百美元。更重要的是,低秩更新可以轻松地与原始权重分开分发,使它们摆脱了Meta原始许可的约束。任何人都可以分享和应用它们。

2023年3月18日 – 现在它变快了

Georgi Gerganov使用4位量化使LLaMA在MacBook CPU上运行。这是第一个“无GPU”解决方案,速度足够快,实用性很强。

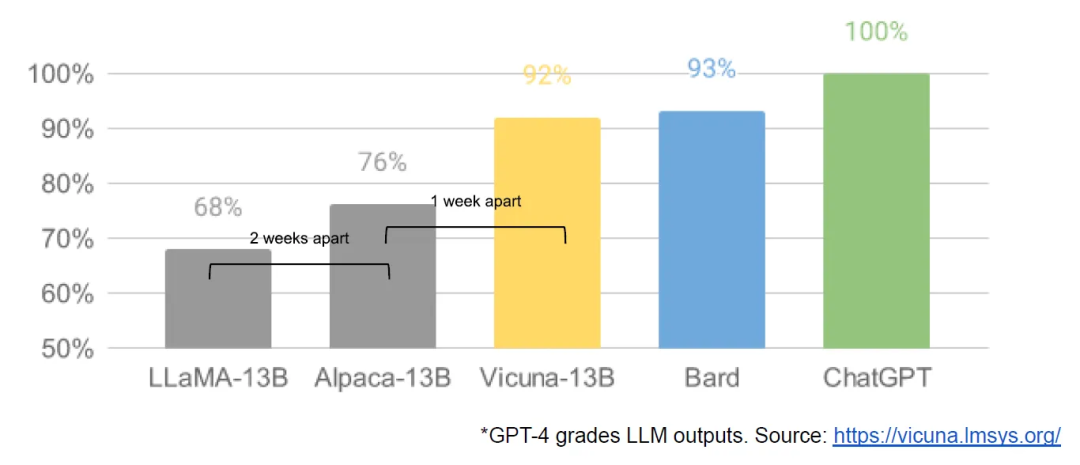

2023年3月19日 – 一台13B模型实现了与Bard的“平衡”

第二天,一个跨大学合作推出了Vicuna,并使用GPT-4驱动的评估来提供模型输出的定性比较。虽然评估方法值得怀疑,但该模型比早期版本的表现要好得多。培训成本:300美元。

值得注意的是,他们能够使用来自ChatGPT的数据,同时规避其API的限制 – 他们只需从像ShareGPT这样的网站上获取“令人印象深刻”的ChatGPT对话样本。

2023年3月25日 – 选择您自己的模型

Nomic创建了GPT4All,这既是一个模型,更重要的是一个生态系统。这是我们第一次看到模型(包括Vicuna)聚集在一个地方。培训成本:100美元。

2023年3月28日 – 开源GPT-3

Cerebras(不要与我们自己的Cerebra混淆)使用Chinchilla暗示的最佳计算计划(optimal compute schedule)和μ参数化(u-parameterization)暗示的最佳缩放(optimal scaling)来训练GPT-3架构。这在很大程度上优于现有的GPT-3克隆,并且代表了μ参数化在实际应用中的首次确认使用。这些模型是从零开始训练的,这意味着社区不再依赖于LLaMA。

2023年3月28日 – 一小时内完成多模态训练

使用一种新颖的参数有效微调(PEFT)技术,LLaMA-Adapter在一个小时内引入了指令调优和多模态。令人印象深刻的是,他们只用了120万可学习参数。该模型在多模态ScienceQA上刷新了新的SOTA。

2023年4月3日 – 真实的人类无法分辨13B开放模型和ChatGPT之间的区别

伯克利推出了Koala,这是一个完全使用免费可用数据训练的对话模型。

他们采取了衡量真实人类在他们的模型和ChatGPT之间的偏好的关键步骤。虽然ChatGPT仍然稍占上风,但超过50%的时间,用户要么更喜欢Koala,要么无所谓。培训成本:100美元。

2023年4月15日 – 开源RLHF达到ChatGPT水平

Open Assistant发布了一个模型,更重要的是,发布了一个用于通过RLHF进行对齐的数据集。在人类偏好方面,他们的模型接近ChatGPT(48.3%与51.7%)。除了LLaMA之外,他们展示了该数据集可以应用于Pythia-12B,为人们提供了使用完全开放堆栈运行模型的选择。此外,由于数据集是公开可用的,它使得对于小型实验者来说,RLHF从不可实现变得便宜且容易。

本文为深思圈编译文章,转载请联系公众号后台参考材料

[1]https://www.semianalysis.com/p/google-we-have-no-moat-and-neither

专栏作家

深思圈,公众号:深思圈,人人都是产品经理专栏作家。《十五个酷应用玩转树莓派》作者,连续创业者。做过教育、工具和SaaS等行业,关注出海、SaaS和AIGC领域,擅长产品、营销和增长。

本文翻译发布于人人都是产品经理,未经作者许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益