幻觉即智能:AI落地里顺势与逆势的分界线

关于AI幻觉的问题,业内不少人都尝试进行了思考和应对,那么现在,在AI落地的过程中,我们是否需要将幻觉当作前条件和不变量来进行思考?幻觉所带来的都是坏处吗?不如来看看本文作者的思考和解读。

大模型是有幻觉的,其表现很多样比如与事实冲突,其成因也很多比如缺相关知识或者对齐错误,不清楚的点就更多。但和应用相关的最为关键的点还不是这些,而是:看起来幻觉是个短期搞不定的事,即使是OpenAI。这就要求在落地的时候把它当前条件和不变量来思考,一旦把它做前条件和不变量,那就会发现像对人类一样,幻觉也并不全是坏处。

一、顺势的和逆势的

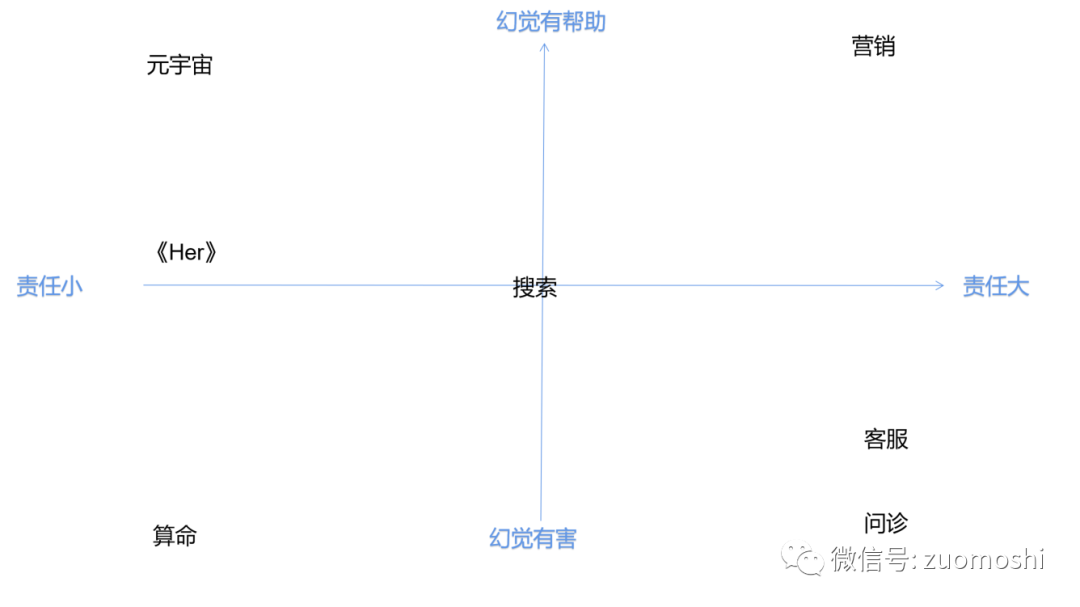

我们把幻觉对产品有帮助还是对产品有害作为纵轴,再加上出问题的责任作横轴,形成一个简单的坐标系,然后再把各种人工智能体放在在这个坐标系上面,那大概是下面这样:

也许对不同人工智能体所处的位置会有争议,但几个极值应该问题不大。

对于元宇宙而言本来就是高级游戏,那人物行为的出格反倒是会激发游戏叙事的多样性,成为丰富世界内容的一部分养料;对于问诊就很麻烦,如果在既有医疗知识框架外发挥,然后病人病情变严重了,那就不单有害,后果还很严重。现实空间和问诊类似的其实更多,包括客服、税务咨询等。

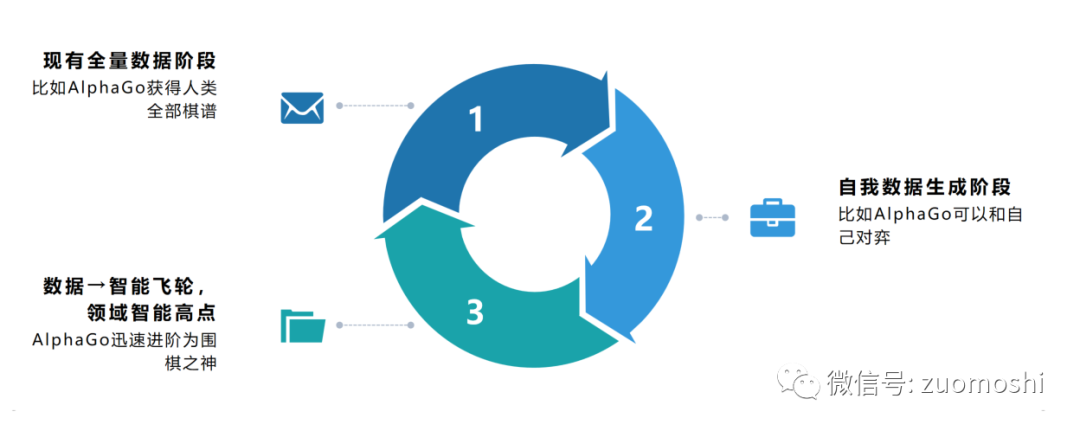

在 寻找智能飞轮:从数据枯竭到多模态再到自生成 里面我们提到过除了AlphaGo还没人转起来智能飞轮,又因为飞轮一旦转起来必然会产生特定领域的神灵,所以关心这个人工智能应用的人都关心到底在那里可能再出下图这样的智能飞轮:

这在上面的象限图上也能找到回答的思路:越偏元宇宙这个方向,越容易些。幻觉可以低责任成本的制造新数据,新数据融入场景,然后反过来就可以作为燃料驱动飞轮。

二、象限中的位置即定位

在象限中的位置对做AI产品落地是非常关键的。

这个位置在相当程度上就决定了你的运营成本乃至于跑的快慢。并且它面对的约束非常刚性,不可改变。

通常的理解里,我们都把产品看成一组特性,用能干什么不能干什么,用功能性能参数等表述,高级一点就用审美偏好衍生的就是品牌。但其实不全面,更深一层产品也是一套权责利系统的汇聚点。这在C端产品上体现的没有B端明显。

在过去很少被提及,因为经济体系里只有一种智能体:人。整个经济体系都按照人、法人来确定的权责利。但现在这套体系其实是碰到了新的挑战,人工智能体的崛起让这种权责体系出现了裂痕,并且运转滞涩。

最简单的例子是过去经常说的自动驾驶,用户、厂家、自动驾驶服务提供商之间会产生新的复杂权责利再平衡。(原来事故的责任基本是用户的,谁开谁负责,用了自动驾驶后就不行)

这会非常麻烦,因为人工智能并非权责利的主体,但似乎又得承担对应的责任。这就导致潜意识的每家公司都尝试拿技术来对冲,让某些坏的事好像可以不发生,但其实这和堂吉诃德战风车差不多,基本不可能。

而和用户、甲方权责利的再平衡其实是会像指挥棒一样决定公司有限资源分配的导向性的。(事实上形成特定位置的一般性社会成本)

投入产出不好,还不得不干的情形,岂不尴尬?

这种尴尬的核心原因就是用技术没办法完全对冲掉的权责。

三、对冲不掉的权责

为什么说技术不可能完全对冲掉权责呢?

这固然是因为技术总是有个成熟过程,但很可能更关键的原因在于但数字和智能让问题显性化的同时,权责被放大了。

面对可以清楚表示的数字结果时每个客户都会希望无限制的解决问题,而这种限度在过去是被抑制了的。

我们可以拿客服举个例子:

当雇佣几千上百的人做客服的时候,服务自身必然有良率问题。但这个时候大家基本能接受一定的错误,每个人都知道人会出错,再加上客服人员还不好找,大家对这个良率就保持了一定的容忍度。假如客服人员服务不好丢失了一单,那最多辞退对应的客服人员或者扣钱。很难向客服追讨造成的损失。

当把客服换成人工智能体后,事情还是那个事情,但权责关系就默默的发生了些变化。

即使人工智能体的良率超过了过往的人工,从甲方的角度看,也还会有足够的动力向提供人工智能体服务的公司追责。而后面的技术公司就得想尽办法让人工智能体不出错。

这就是用技术对冲权责。

本质是用技术解决近乎无限的领域问题。越到后来越变成捣糨糊,因为搞不定。人工智能这行业从智能音箱的唤醒开始就不停的反复这故事。

而实际情况是即使是古老的搜索引擎如果要求不出错比如某类内容出现一次就灭掉,那谷歌、百度这样的公司都不知道死多少次了。

但这种权责体系的容忍度其实有非常多的成因,有历史的文化的商业现实的,十分刚性,不太可能改变。而如果它不能改变,那就并不怎么适合纯粹的人工智能体。能想到折中方法就是把人再塞回去,即使这个人什么不干,只做做样子,那也是他在履行工作职责,人工智能体服务于他,他对所有产出负责。

这样一来,选择和定位就很关键,因为权责系统本身就是成本、方向和客户满意度(“想都是问题,干才是答案”是错误的,雷军说也不行干就完了不对的老话题)。在幻觉本就是智能的一部分的前提下,真跑到权责系统非常沉重的领域,那其实是事倍功半的。

基于这个视角,我们还可以再拔高一点,谈一点新技术的应用模型。

四、新技术的应用模型

在探讨应用模型的时候我们先回到人类本身。

人类文明的核心子系统:政治经济文化其实全是先虚后实,实又促虚这么反复倒腾来的。

这些在想象和某种逻辑合理性的基础上,加上另外一波人找到了想象到物理定律、商业游戏之间的联系,然后想象就会照进现实。火车、电、汽车、手机等差不多都是这么来到了世界上。

然后我们再截取1912年2月12日,溥仪退位这个时间点回溯,看看想象的作用。

今天对我们影响至深的产品很多其实都是1912年以前发明的,产品上包括蒸汽机、汽车、电、青霉素、电话、摄影机、电池等,人物则包括诺贝尔、爱迪生、特斯拉、福特等。这些产品出世后大致是不顺的,比如蒸汽的汽车就经常爆炸、爱迪生曾经主力攻击交流电危险容易电死人,但相对宽容的环境让这些产品都存续了下来。

这给我们什么启示呢?

新技术在一般性社会成本低的地儿开始更合适。权责系统越宽松,试错成本越低,越有助于新技术驱动的不成熟产品转起来。

整体一般性社会成本的事很复杂,这里不展开。(就是怎么避免在火车出现的时候,坚信它会破坏风水。)

对于创新主体的个人,显然的要规避复杂权责系统。

因为技术不成熟如果还要用它来对冲复杂权责的风险,那肯定吃力不讨好。

回到人工智能更具体一点会是什么样呢?

环境本身的宽松与否在这个时间点看着也许不关键,复杂权责系统也许还更容易形成现金流。但越往后可能会更关键。因为潜在智能飞轮会起作用,所以这就真的是1.01的99次方和0.99的99次方的差别。

凯文凯利在科技想要什么里表达了这样一个观点,那怕科技带来的好处只多余坏处一点点,那随着它本身的强大,那影响的结果也是非常显著的。

对人工智能体也是一样,这一点点差异到后面可能就是智能飞轮转不转的起来的差异。

简单说就是属于人工智能自身的应用模型是:要找幻觉有益,权责对冲没那么复杂的领域,然后由内而外的成长,而不是揠苗助长。

(揠苗助长的、盯的越紧的,潜在效果越差)

五、小结

从这个角度看,确实幻觉就是智能,至少是智能飞轮的原动力。很多时候恰恰是幻觉给了我们一种智能的感觉,彻底的去除幻觉还保持智能,就真的是得达成一种超级单一体(克里人的终极智慧),这是很好的理想,但我觉得如果假设人工智能不可能建成完备的世界模型,那去除这种幻觉就是不可能的,所以与其指望用技术解决这问题,就不如根据技术的进展修正应用模型。

专栏作家

琢磨事,微信公众号:琢磨事,人人都是产品经理专栏作家。声智科技副总裁。著有《终极复制:人工智能将如何推动社会巨变》、《完美软件开发:方法与逻辑》、《互联网+时代的7个引爆点》等书。

本文原创发布于人人都是产品经理。未经许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

起点课堂会员权益

起点课堂会员权益

AI错误的问题在类安防领域表现的非常明显,本来需要交警来查闯红灯,没人查就没案件,现在上了AI摄像机,AI识别抓拍闯红灯,案件数一下暴涨数百倍,其中还有大量误报,让交管部门如何处理?

这个问题在垃圾分类领域表现的更为严重,我们用AI识别居民乱丢垃圾,一个投放点一天能报出上百个案件,因为环境复杂多变各种误报都有,更大的问题是谁来处理这些案件呢?社区没有执法权,城管有权但没空,就算有权又有空还要考虑社会影响。

所以我的判断是AI在需要严谨区分对错的领域都不能完全取代人类,因而无法实现真正意义上的效率提升。