GPT4o爆火的底层秘密:自回归模型与扩散模型

GPT-4o的爆火引发了广泛的关注,其背后的技术原理更是值得深入探讨。本文将揭开GPT-4o的底层秘密,重点分析自回归模型与扩散模型这两种生成范式。

这两天时间,因为GPT4o的爆火,导致了无数设计师上天台!前几天本人还在嘲笑因为Cursor和MCP的出现,导致很多程序员上天台,谁能想到射出的子弹这么快便击中了我的眉心!

自己也是开通了GPT4o,玩了一整天,确实大为震惊,不仅可以生图,还可以生成文档!

但是!话说回来,今天要讲的不是GPT4o模型生图有多厉害,今天来讲一下背后的原理!他和Stable Diffusion的图像生成到底有什么区别?

自回归模型与扩散模型:起源、区别与演进

自回归模型(Autoregressive Model)和扩散模型(Diffusion Model)无疑是两种最具代表性的生成范式。它们源于不同的建模思路,发展路径各异,但又在今天的AI系统中交汇融合,形成了新一代多模态AI如OpenAI的GPT-4o和Google的Gemini 2 flash。本文将带你梳理这两种模型的起源、区别,并解析它们在当今AI体系中的实际应用与联系。

一、自回归模型(Autoregressive Model)

起源与发展

自回归模型起源于统计学中的时间序列分析,用于预测当前值与过去值之间的关系。在人工智能领域,自回归模型被引入语言建模中,即假设一句话可以通过逐词预测的方式生成。

在NLP中,最早的语言模型如n-gram就是一种简化的自回归模型,而随着深度学习的发展,RNN、LSTM、GRU等循环神经网络被广泛用于自回归建模。真正让自回归模型成为主流的,是2017年Google提出的Transformer架构,其编码-解码结构让语言建模的效率和效果大幅提升。

基于Transformer的自回归模型中,最具代表性的就是OpenAI的GPT系列。以GPT-3为例,它通过左到右地依次预测每一个token,从而生成连贯的文本内容。这种方式结构简单、效果稳定,并且容易训练和部署。

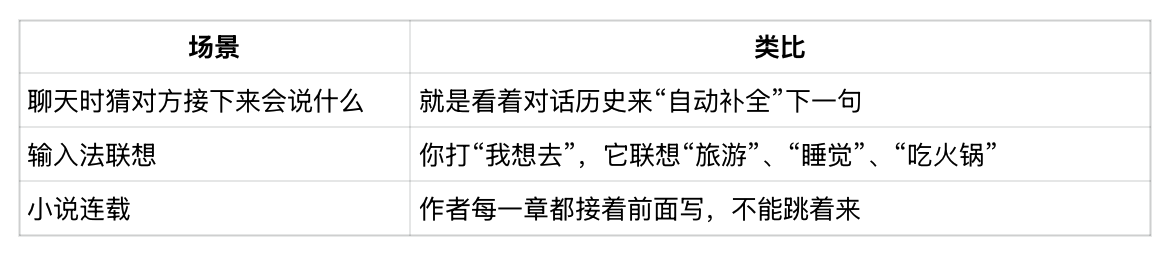

自回归模型核心思想是什么

自回归模型的核心思想就是:“我预测下一个东西,要参考前面已经发生的。”换句话说,就是**“我边看边猜接下来会发生什么。

例:假设你写一篇作文,开头写了:“今天阳光明媚,我走在…”你会很自然地想到接下来的词可能是:“街道上”、“公园里” 或 “校园里”这时候,你的大脑就是一个“自回归模型”——你写下一个词,是基于你前面写的内容来推断的。

再比如:你听到“我昨天晚上吃了”,你会自动脑补“炸鸡”、“火锅”之类的。这也是自回归思维。

再通俗一点就是

AI 里的自回归模型长啥样

在AI模型里,比如 GPT,生成文本的方式就是:一个词一个词地生成,每次都看前面都生成了啥,然后决定下一个词是什么。

比如 GPT 生成句子:“I love artificial…”它可能预测下一个词是 “intelligence”,然后:“I love artificial intelligence…”再继续生成下一个词:“because”,如此循环。

二、扩散模型的起源与发展

起源与发展

扩散模型最初起源于对随机过程的建模,尤其是布朗运动等物理扩散现象。2020年,Ho等人提出了DDPM(Denoising Diffusion Probabilistic Model),标志着扩散模型在生成建模领域的重大突破。

扩散模型的基本思想是:首先将一张图像逐步添加高斯噪声直到变成纯噪声(正向扩散),再训练模型学习如何从这个噪声中一步步还原原始图像(反向去噪)。由于每一步都是在已有信息的基础上微调,模型可以生成极高质量的图像。

以Stable Diffusion为例,该模型结合了UNet结构和CLIP的文本引导能力,在输入一段提示词后,从随机噪声中“生长”出一张符合语义的图片。这种方式虽然推理速度较慢,但图像质量和控制力远超以往的模型。

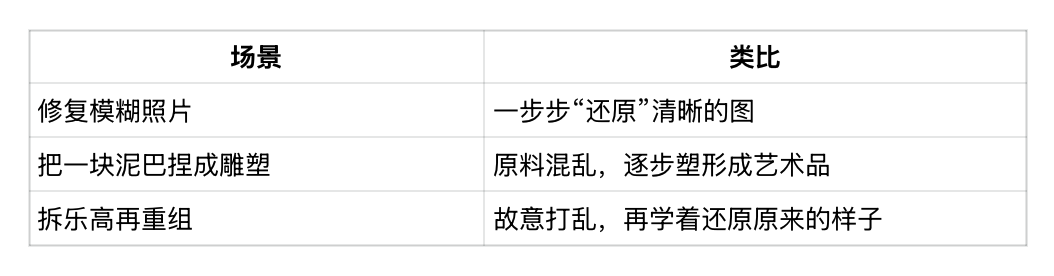

扩散模型核心思想是什么

扩散模型的核心思想是: “我先把东西变模糊(加噪音),然后一步步把它变清楚。”也就是:“先破坏、再修复!”

例:假设你有一张小时候的老照片,已经模糊不清、满是噪点,你会怎么做?

你可能会用 AI 修图工具,一点点去掉噪点、恢复颜色、补全缺失的部分,直到还原成一张清晰的照片。

这过程就像是扩散模型做的事情:先把图像加噪音变模糊 → 再训练一个模型一步步学会去噪 → 未来可以从一张“随机噪音”里生出一张图像!

再通俗一点就是

AI 里的扩散模型长什么样

比如你在用 Stable Diffusion 画图:你输入提示词:“一只在宇宙中弹吉他的猫”系统不是一下子画出来的,而是:

1.先生成一张全是灰点的“噪声图”;

2.然后一步步“去噪”,让图像慢慢显现;

3.直到最后得到一张超级有细节的猫猫图!

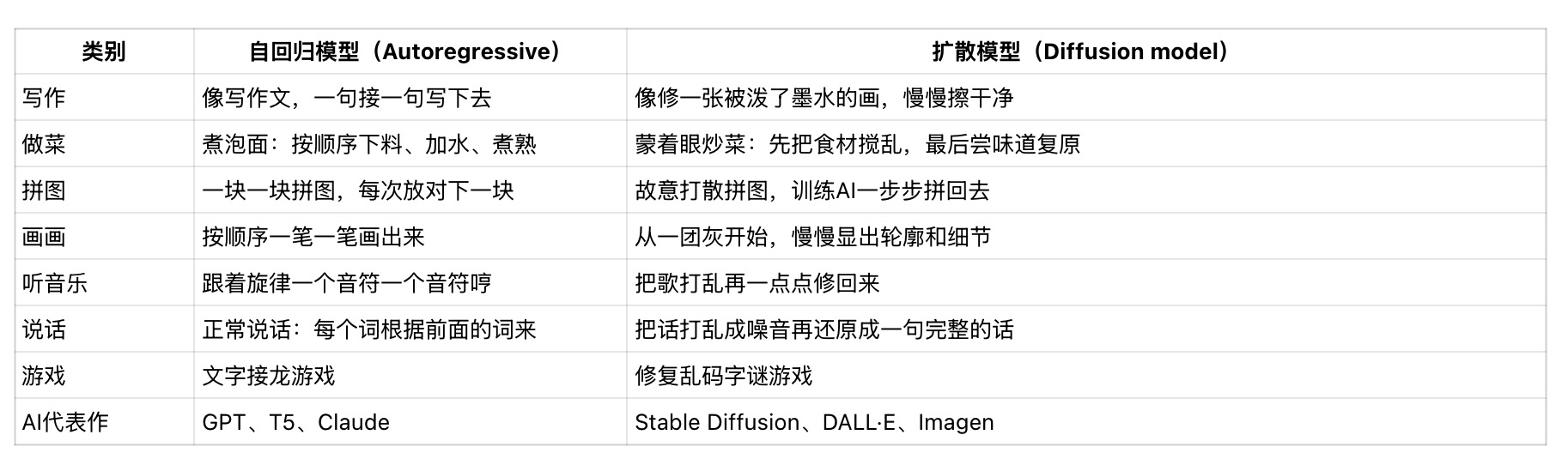

三、自回归 vs 扩散:关键区别与类比

结尾小口诀,帮你记住:

- 自回归:从左写到右,步步推演;

- 扩散式:从糊到清晰,渐入佳境!

本文由 @A ad钙 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务

起点课堂会员权益

起点课堂会员权益

这或许就是AI进化的魅力所在——不同技术路线的融合往往能碰撞出意想不到的火花。

是的,不需要像SD那样调节负责的参数,用繁琐的工作流也可以生图