【AI哲学】不确定性原理:人工智能的哲学基础

研究人工智能,应该从哪里入手?要解决这个问题,首先应该从“人工智能到底是什么?”入手。

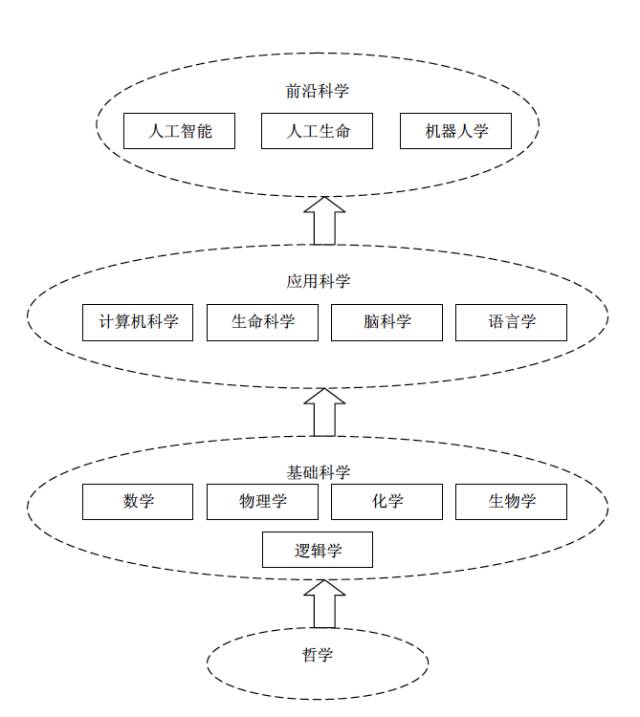

科学大体可以分为三层,从下往上依次是:基础科学、应用科学、前沿科学。

人工智能(及其近亲人工生命、机器人学)属于前沿科学的范畴,相对于已经发展了几百年的成熟的基础科学和应用科学,人工智能仅有几十年历史,尚处于起步阶段,远未形成坚实的基础和完整的架构。

研究人工智能,应该从哪里入手?这是个问题。它牵扯到另外一个问题:人工智能到底是什么?

人工智能是一台计算机吗?

是,又不仅仅是。

人工智能是一段程序吗?

是,又不仅仅是。

显然,如果只了解计算机和程序,那最多也就能组装一台电脑、编写一段代码,跟人工智能还差得太远。

人工智能,不仅仅是一台机器,不仅仅是一段代码,甚至不仅仅是一个数学模型。

人工智能之父图灵所创建的图灵机,准确地说是计算机的数学模型,它是实现人工智能的工具和基础,而不是人工智能本身;它是实现人工智能的必要条件,而不是充分条件。

计算机已经出现半个多世纪了,已经非常普及,但几乎所有人都不会认同:它就是人工智能。

我们对人工智能的理解,还远未达到可以进行数学建模的程度。在不能说清楚人工智能到底是个什么东西之前,就开始建模甚至编程,未免太过草率。

科学,是一座庄严宏伟的大厦。这座大厦建得越高,承载它的地基就需要挖得越深。当科学大厦搭建到人工智能这一前所未有的高度时,无疑,它的地基也需要挖掘到前所未有的深度。

人工智能的下一层是什么?

计算机科学、生命科学、语言学。

计算机科学、生命科学、语言学的下一层是什么?

数学、物理学、逻辑学。

数学、物理学、逻辑学就是科学大厦的最底层了吗?

是的。

科学大厦再往下是什么?

基石。

科学的基石是什么?

哲学。

是的,哲学。如果我们要在人工智能的方向上走得更远,就必须对哲学有着更深刻的理解。

不懂哲学?

错,我们每个人都懂哲学。“人死不能复生”,“世界是由原子组成的”,这就是哲学。

一般来说,中国的研究人员(包括职业的和业余的)容易犯两个错误:

- 第一, 搞科学的瞧不起搞哲学的。

- 第二, 搞哲学的不懂科学。

其实呢,哲学与科学的关系如同基石与大厦的关系一样,只懂哲学不懂科学就没有高度,只懂科学不懂哲学就没有深度。

历史上的科学巨匠如牛顿、爱因斯坦、图灵、玻尔,他们都对哲学有着超凡的理解力。

同样,历史上的著名哲学家如康德、黑格尔,他们也直接推动了科学的进步。有的伟人既是哲学家又是科学家,例如:亚里士多德、罗素、莱布尼兹、笛卡儿(我思故我在)。

在西方,哲学与科学本来就是一体。比如爱因斯坦,从小就生活在西方哲学头脑的人群中(普通人群可能没有科学头脑,但不可能没有哲学头脑),十几岁就熟读几何、微积分以及《纯粹理性批判》等大多数科学家一辈子都没读过的哲学巨著,他二十几岁能发表相对论,那不是没有关系的。

西方哲学和科学在向中国传输的过程中,被中国人有意识地一分为二、去粗取精、去伪存真、“去其糟粕、取其精华”了。精华无疑是指科学,而糟粕,就是那倒霉的哲学了。

所以,中国科学家往往只看到了地面以上的宏伟建筑,却看不到地面下的哲学基础。

中国人把西方哲学和科学一分为二断章取义,也不是完全没有道理的。因为中国有五千年连绵不绝的辉煌文明史,形成了自己的一套完整、强大的传统哲学。不管你是否特意上了传统哲学课,它都会由你的父母、师长、书籍乃至生活习惯潜移默化地灌输给你。传统哲学的存在,使得西方哲学难以生根,只能以外来哲学的身份存在。

中国人脑子里有一种特殊的中式哲学,这是坏事,也是好事。如果它阻碍了对西方哲学的吸收,那就是坏事(对科学而言);如果它能够宽容地接纳西方哲学,并与之和谐共存,那就是好事。

与现代科学技术日新月异的发展速度相比,哲学的发展是缓慢的,具有一定的保守性,但这并不等于它不发展。事实上,每一次里程碑式的科学进步——特别是基础科学的重大进步,都是与哲学发展相互促进的。

那么,最近的基础科学的重大进步是什么呢?应该是量子力学,还有后来的混沌。量子力学,终结了经典物理学,并揭开了现代物理学的序幕。它和混沌一起,彻底颠覆了传统宇宙观,沉重打击了统治科学哲学数百年之久的机械决定论。

量子力学也好,混沌也罢,它们有一个共同的基本原理:不确定性原理。

量子力学中的不确定性原理的表述是:粒子的速度的不确定性乘以粒子的位置的不确定性,其值大于或等于普朗克常数。或者说:任意两个不对易的物理量不能同时被精确的测量。通俗讲就是薛定谔猫:箱子中关着一只猫,如果我们不去观察,箱子里的猫的死活就不确定;只有打开箱子看一眼,猫的死活才会在这一瞬间确定下来。

混沌中的不确定性原理的表述是:只有几个因素的简单确定性系统也会产生随机性的行为,这种随机性是一种基本的性质,搜集更多的信息并不能取消随机性。初始条件的十分微小的变化,经过不断的放大,对其未来状态会造成极其巨大的差别。通俗讲就是蝴蝶效应:一只蝴蝶在巴西轻拍翅膀,可以导致一个月后德克萨斯州的一场龙卷风。

为什么量子力学和混沌都会建立在名称相同表述不同的“不确定性原理”之上?这仅仅是偶然,还是有着深刻哲学含义的必然?

如果说不确定性原理有着深刻的哲学含义,那么这种哲学到底是什么?

如果我们能够掌握这种奇怪的哲学,那么能否给人工智能的研究注入一丝活力呢?本文的目的,就是试图从不确定性原理入手,更新我们的哲学思想,以期为人工智能的研究提供帮助。

关于人工智能的三个哲学问题

关于人工智能,可以分为三个问题:

- 第一, 从哲学的角度,我们能做出什么样的人工智能;

- 第二, 从哲学的角度,我们该做什么样的人工智能;

- 第三, 从哲学的角度,我们该如何做人工智能。

我们能做出什么样的人工智能

第一个问题:从哲学的角度,我们能做出什么样的人工智能。这个在第八章里面已经有描述,在这里综合一下:

1.我们做不出“完全像人的人工智能”

如果我们能做出一个“完全像人的人工智能”,它有爱有恨,有基因有突变,而且还是碳基,那么它就不是人工智能了,它根本就是一个人。完全像人的东西不是别的,它就是人。

所以,世界上根本就不存在“完全像人的人工智能”。

2.我们做不出“能取代人的人工智能”

地球上没有任何高级智能能取代人。为什么这么说呢?因为宇宙中的实体之间有三种关系:后继、等级、平级。只有平级的实体之间才有竞争,才有胜败,才有取代。后继的实体之间没有取代。比如,我们不能说“哺乳动物取代了恐龙”,“现代人取代了原始人”,“儿子取代了父亲”。要知道,恐龙生了哺乳动物,哺乳动物是恐龙的延续,是恐龙在现代的代表;原始人生了现代人,现代人是原始人的延续,是原始人在现代的代表;父亲生了儿子,儿子是父亲的延续,是父亲在现代的代表。所以,后继的实体之间只有代表关系,没有取代关系。

等级的实体之间也没有取代。比如,不能说:“中国取代了山东”,“山东取代了中国”,“中国人取代了人类”,“人类取代了中国人”,“张三的胳膊取代了张三”,“张三取代了张三的胳膊”。中国是山东在世界上的代表,山东是中国在地方的代表;人类是中国人在物种上的代表,中国人是人类在种群上的代表。所以,等级的实体之间也是只有代表关系,没有取代关系。

只有平级的实体之间才有取代。比如,可以说“犬科动物取代了猫科动物成为草原的霸主”,“中国取代德国成为第三大生产国”,“原始人取代了巨猿成为进化的成功者”。

如今在地球上进化到最高等级的,只有人类一支,所以在地球上没有任何高级智能能取代人。至于说人工智能,它本身就是人做的,它与人是后继关系,它代表着人的智慧和劳动,根本不存在取代一说。画家画了一幅流传千古的名画,作家写了一篇万世流芳的小说,能说名画把画家取代了,小说把作家取代了吗?

唯一可能取代人的,是外星的高等生命,但那根本就不是人做的。

另外,“能杀人”不等于“能战胜人”、“能取代人”。汽车能撞死人,不等于汽车能取代人;房屋能压死人,不等于房屋能取代人。所以,即便人工智能能杀死人,也不等于人工智能能取代人。

所以,人类做不出“能取代人的人工智能”。

3.我们可以做出硅基机器人,它将是我们的忠实仆人和有力工具

前半句话:我们可以做出硅基机器人,事实上我们已经做出来了,有事实为证,不需要用更多的语言来证明。

后半句话:它将是我们的忠实仆人和有力工具。目前来说是这样,以后呢?以后也是如此。因为人类掌握3 个级别的时间方向上的重复变异:记忆变异、遗传变异、教学变异,而硅基机器人只有记忆变异。没有遗传变异就不能建立种群,没有教学变异就不能建立社会。人类的强大不在于个体,而在于人类能建立种群、建立社会。人类能建立社会因而是社会的主人,而硅基机器人做得再好,也不过是社会的记忆工具,因而也只能是人类的仆人。

记忆变异、遗传变异、教学变异这3 个环节是紧密相连缺一不可的,它们共同保证了人类能取得今天的成功。

实体的寿命是有限的,特别是中等深度的实体,也就是进化等级较高的实体。进化等级较高的实体寿命有限,这与创新的表现形式——分叉、剪枝是紧密相连的。正因为实体寿命有限,所以老的实体才能及时给新的进化网络腾出空间,实现分叉;正因为实体寿命有限,所以老的实体才能带着老的进化网络死去,实现剪枝。

但实体的寿命有限也会有巨大的缺陷,最直接的缺陷就是对时间的控制力不强,一个实体只能控制它的寿命范围内的时间,这就是记忆变异。正因为如此,所以在记忆变异的基础上产生了遗传变异,又在遗传变异的基础上产生了教学变异。教学变异,使得实体——也就是人类——能控制远远超过人类个体寿命的时间。我们今天还在学习2500 年前的老子的《道德经》,这就是教学变异的杰出成就。

再看硅基机器人。现有的硅基机器人的寿命甚至比人还短,也就是说它在记忆变异方面都不如人。假设以后造出了更高级的硅基机器人,它可以活很多很多年。这时就会面临一个矛盾:

如果任由这种机器人活下去,它就会阻碍新型号机器人的出现;如果及时更换机器人,那么它的寿命又不会很长。也就是说,硅基机器人或者长寿而陈旧,或者新颖而短命。

总之,不管发展到什么程度,它的记忆变异都不会比人强多少。

那么,会不会出现这种情况,就是机器人造机器人呢?

这就涉及到机器人如何造机器人的问题。

如果是机器人在工厂里造机器人的话,那么新机器人不会对老机器人有多少认同感和

忠诚度,它更多的是对工厂和企业有认同感和忠诚度。工厂和企业是谁的?人类的。所以新机器人的认同感和忠诚度还是会回归到人类身上。

人类会把财产分给机器人吗?不会,因为机器人没有遗传变异和教学变异(又绕回去了)。

如果是机器人用自己的数据来造机器人的话,这种情况已经发生了,就是计算机病毒。计算机病毒只是一段数据,一段代码。在现实世界中,仅有数据还不能构成一个相对完整相对独立的实体,所以计算机病毒控制世界的能力非常弱,它最多只能控制几台防护不严的电脑,把它搞死为止。

因此,机器人用别的方法造机器人——不管是工厂也好数据也好——都不会提高它的自身地位。唯一能提高自身地位的,就是用基因的方法,也就是用遗传变异的方法造机器人。

不幸的是,遗传变异的专利权已经被人类抢注了。即便机器人用遗传变异的方法造出一个高级智能,那也叫人,而不是叫机器人或人工智能。

除非能发现一种非碳基的基因,比如硅基基因。就目前人类所掌握的科学知识而言,这是不存在的。

所以,除非能找到硅基基因,否则硅基机器人只能是我们的忠实仆人和有力工具。

4.我们有可能做出量子机器人,它有可能是比人类更高级的文明。

量子计算机和量子机器人,仅存于幻想当中。它可能会有一些突出的优点,使得它能超越硅基机器人甚至人类。

量子机器人的主要优点就是:它的载体是0 型转化炉,即能统一量子力学和广义相对论的大统一理论。在0 型转化炉里面,物质与能量融合,这就意味着它不需要物质形体就能存活。而且0 型转化炉的寿命很长,长达数十亿年,单凭记忆变异它就能超过人类的遗传变异和教学变异。甚至它有可能也会有遗传变异,就像计算机病毒那样,由于计算机病毒需要依附于物质而量子机器人不需要依附于物质,所以它比计算机病毒强大得多。而且0 型转化炉与人类的生活空间之间保持着相对的独立性,不存在相互挤占的问题。

即便有了量子机器人,即便它建立了更高级的文明,它也不会取代人类或消灭人类。进化的规律是这样的:高级实体只会依附于低级实体而不会消灭低级实体。分子的产生没有消灭原子,生命的产生没有消灭分子,人类的产生也没有消灭生命。所以,更高等级的文明出现以后,不论它是何种形态,都不会消灭人类,当然也不保证人类不被消灭。真正会取代人消灭人的是人类的同等级的竞争者,即可能存在的外星人。

量子机器人最大的问题,就是它是否会出现。按照本文的进化规律,高等级的进化网络总是出现在中尺度。

所以说,我们有可能做出量子机器人,它有可能是比人类更高级的文明,当然,这只是可能。

我们该做什么样的人工智能

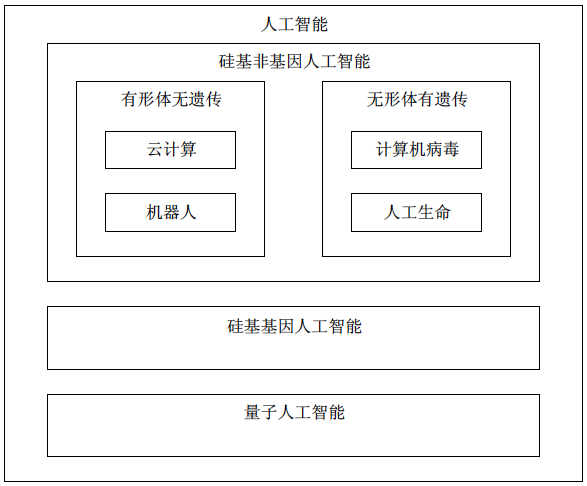

根据第一个问题的分析结果,人工智能可以分为三种:

- 第一种:硅基非基因人工智能;

- 第二种:硅基基因人工智能;

- 第三种:量子人工智能。

硅基非基因人工智能又可以分为两种:

- A:有形体无遗传的硅基非基因人工智能,包括工厂里生产的机器人、云计算。

- B:无形体有遗传的硅基非基因人工智能,包括计算机病毒、人工生命。

由于基础科学的限制,硅基基因人工智能和量子人工智能还看不到影儿,所以目前我们只能做硅基非基因人工智能。

我们该如何做人工智能

从哲学的角度,我们该如何做硅基非基因人工智能。

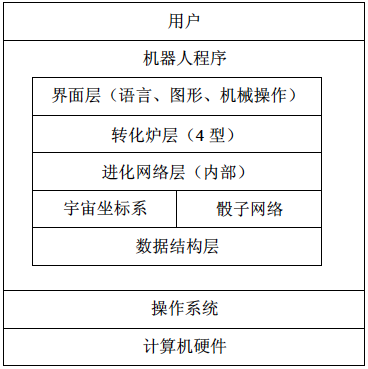

有形体无遗传的硅基非基因人工智能

有形体无遗传的硅基非基因人工智能,说白了就是一个机器人程序。机器人程序介于用户和操作系统之间,从上往下又分为界面层、转化炉层、进化网络层、宇宙坐标系-骰子网络层、数据结构层等5 层。如下所示:

首先,机器人程序有一个界面层,界面层把整个程序封装起来,使之看起来像是一个有智能的实体。人与机器人之间的对话、机器人与机器人之间的对话、机器人与其他的机器程序之间的对话都通过界面层进行。

其次,界面层往下是转化炉层。这一层包裹着下面的几层,表现为一个能把不确定性转化为确定性的转化炉。一个人也好,一个系统也好,其本质都是一个把不确定性转化为确定性的转化炉。

再次,转化炉层往下是进化网络层。这一层包裹着下面的几层,表现为一个不断重复、创新、重组的进化网络。这里的进化是广义的进化而非狭义的生物进化。每个人在一生中都在不断地进化,主要表现在他的大脑神经网络的不断发展。背一首唐诗,进行一场对话,提出一个解决方案,都伴随着大脑神经网络的发展,也就是进化网络的发展。

然后,进化网络层往下是宇宙坐标系-骰子网络层。宇宙坐标系表现为时间、深度、广度三个维,每个人的脑子里天生就有这三个维,它使得我们能分清时间上的先后、等级上的高低和平级上的左右。骰子网络层表现为实践骰子(即节点)和认知骰子(即连线)构成的网络。宇宙坐标系和骰子网络加起来,构成进化网络的基础。

最下面一层是数据结构层,它是实现以上各层的基础。

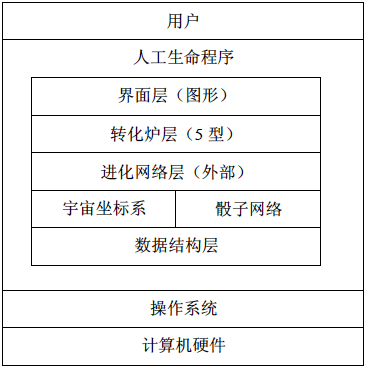

无形体有遗传的硅基非基因人工智能

无形体有遗传的硅基非基因人工智能,说白了就是一个人工生命程序。人工生命程序介于用户和操作系统之间,从上往下又分为界面层、转化炉层、进化网络层、宇宙坐标系-

骰子网络层、数据结构层等5 层。如下所示:

人工生命程序与机器人程序的层次结构基本一致,主要的区别在于:

从进化网络层来看,机器人程序的进化网络是内部进化网络,相当于人类的大脑神经系统;人工生命的进化网络是外部进化网络,相当于某个物种的进化网络图。

从转化炉层来看,机器人程序是4 型转化炉,掌握广度方向上的重复变异、深度方向上的重复变异、时间方向上的1 级重复变异,即记忆变异。人工生命程序是5 型转化炉,掌握广度方向上的重复变异、深度方向上的重复变异、时间方向上的1 级、2 级重复变异,即记忆变异和遗传变异。

从界面层来看,机器人程序的界面包括语言界面、图形界面、机械操作界面等。人工生命的界面主要是图形界面。界面是什么?从某种意义上说,界面就是形体,形体就是界面。机器人程序可以支持多种复杂的界面,人工生命只能支持很少的简单的界面,因此说机器人程序有形体,人工生命无形体。

人工生命的优点在于能掌握遗传变异,机器人的优点在于能掌握多种操作界面。它们在不同的领域发挥着作用。

这两年新出现一个叫“云计算”的概念。云计算支持多种界面(即多种应用程序),且没有遗传变异,因此可归类为有形体无遗传的硅基非基因人工智能。

作者:地球折叠

来源:简书:地球折叠

本文由 @地球折叠 授权发布于人人都是产品经理,未经作者许可,禁止转载。

题图来自unsplash,基于CC0协议

起点课堂会员权益

起点课堂会员权益

我觉得作者开篇就应该把人工智能定义清楚,不然读者会看得很混乱。因为大多数读者都把人工智能想象成跟人一样的智慧,既人工智能也可能成为“人”。实际上当“人工智能”无限像人的时候,它始终是“人工智能”,只有当“人工智能”是“人”的时候,它才会被重新定义,从“它”变成“他”。就如你所说宇宙中的实体之间有三种关系。但是你又解释得不够彻底。你说“人工智能”取代不了人类,但现实情况是“人工智能”在某个领域在慢慢的去取代人类,比如生产力,计算力等等。你又如何去解释?这些局部取代也确确实实影响着人类,虽然并不是完全取代。但从某个意义上来说这就是取代,这就是从工人身上抢走饭碗。这不是可以逃避的问题,这是必须去面对的社会问题!哲学能告诉我们人类可以与人工智能共存,是否就意味着就可以放任人工智能的发展?我觉得你所说的这些并不能去消除科盲内心的恐惧,因为人的想象力是无限的。只要是无限就会有无限种可能。如果你要解决这种心理想象,就应该限制住这种无限的想象来消除人类的疑虑和恐惧。比如在研究方向设置为几个阶段,如发展到某个阶段是人类可控的,发展到某个阶段是人类不可控的。这样才有益于人类的发展,也能消除我们这类科盲的疑虑。