ChatGPT的创业机会

2023年9月9—10日,人人都是产品经理联合腾讯大讲堂举办的【2023产品经理大会(北京站)】完美落幕。宜创科技CEO宜博老师为我们带来《ChatGPT的创业机会》为题的分享,本文为演讲内容实录。目前大会回放已上架,戳此购买,即可收看回放:https://996.pm/7gX2B

今天和大家分享的内容为《ChatGPT的创业机会》,将和大家分享大模型应用的真实案例,同时会理清背后的技术脉络和行业现状,最后分享一些自己对当前创业机会的想法。

一、介绍N个AI真实开发案例

我们在过去两个月里做了20多个AI案例,每一个都是真实案例。大家总觉得大语言模型有幻觉,其实这是大语言模型AI预测算法的本质。但是怎么找到某些场景,即用大语言模型,又要实现100%准确的效果,是每个创业者都可以思考的方向。

1. 某行业领域服务机器人场景及落地

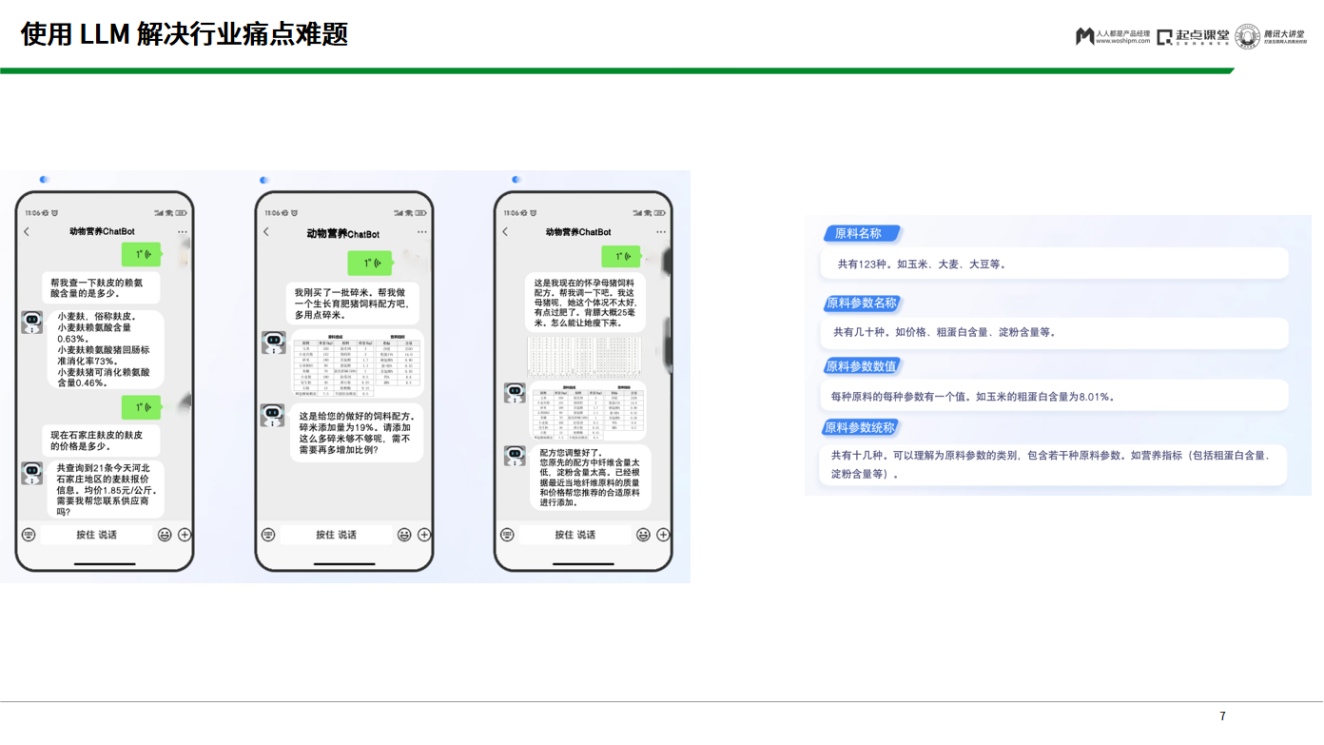

这个例子,是农业企业做的生成猪饲料配比的服务机器人,通过对话,给养殖户提供猪饲料配方,准确率可以达到100%。

第一步,通过多轮对话从养殖户那里获得猪的信息,例如猪的品种、猪有多重等。第二步,拿着这些信息去后台查询这种猪需要的营养量。最后,通过算法计算,获得准确的猪饲料配方,返回给养殖户。同时,我们还做了多意图识别,如果想询问某个产品的营养含量、产品价格,结果都能实现。

这个案例解决了一个行业难题。一直以来,我们都在朝着精细化养殖的方向努力,但是养殖户没有能力从大量的资料中查阅中得知猪饲料配比,这个项目就解决了这个问题。这个项目获得了农业部会议上四个院士的高度赞赏。

2. 某银行需求及落地案例

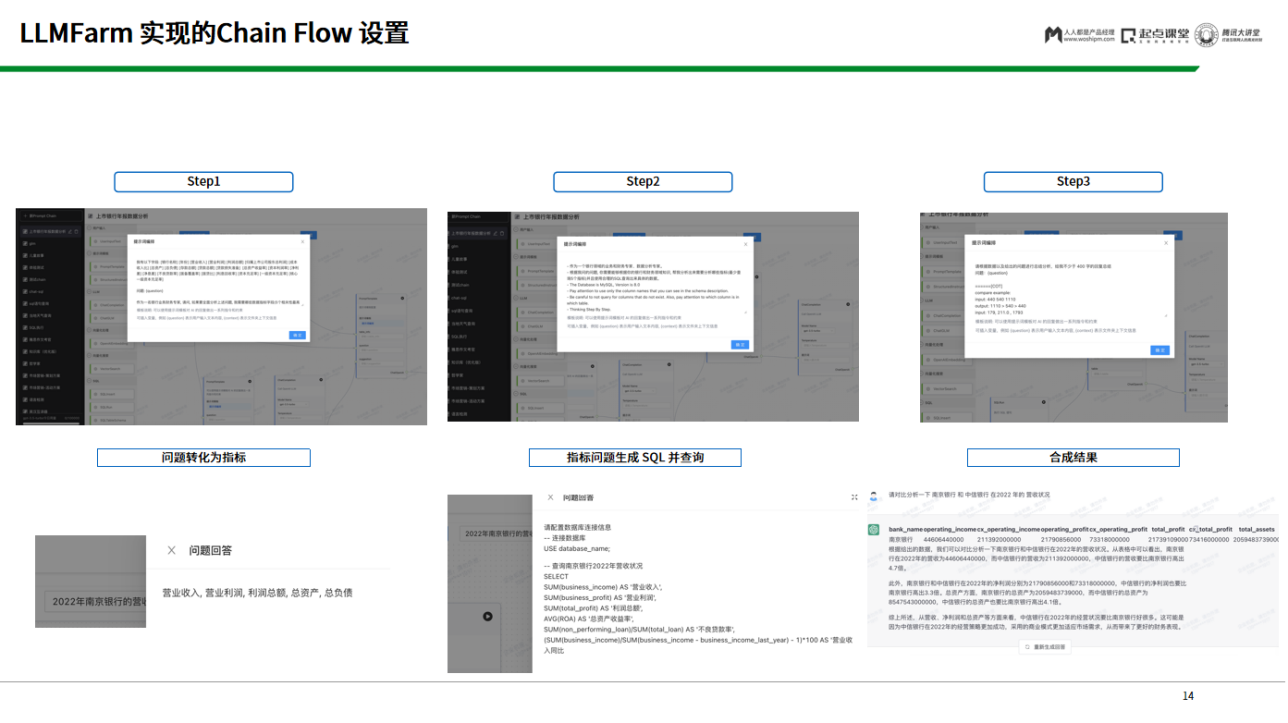

第二个案例来自上市银行。每次上市公司年报分析出来,大家都会问很多问题。一家商业银行提供了他们最常被问到的150个问题和回答。每一个问题里都包含着很多行业的“黑话” ,比如对公贷款、零售贷款等。而这些概念背后对应了很多指标,比如增长率、收入比等,指标要转换成公式,公式结果要整理成报告。

在此之前,其实已有其他金融大语言模型公司尝试做了一下,但出来的数据都不能保证正确率,开始我们采用了大模型结合向量搜索的方式尝试,也不能保证100%准确。后来我们用大模型加工作流的方式解决了这个问题。

第一步,把数据抽取出来存到数据库里。第二步,用大模型做分词,也就是从用户输入问题的内容里提取出各种指标。第三步,查询指标和指标公式,让大模型融合生成数据库查询,生成准确的计算结果。

最后,将准确的计算结果再次输入大模型,做一轮知识融合,可以转化API为领域机器人进行全域问题查询,实现100%数据准确。

3. 某KMS机器人集成飞书钉钉场景

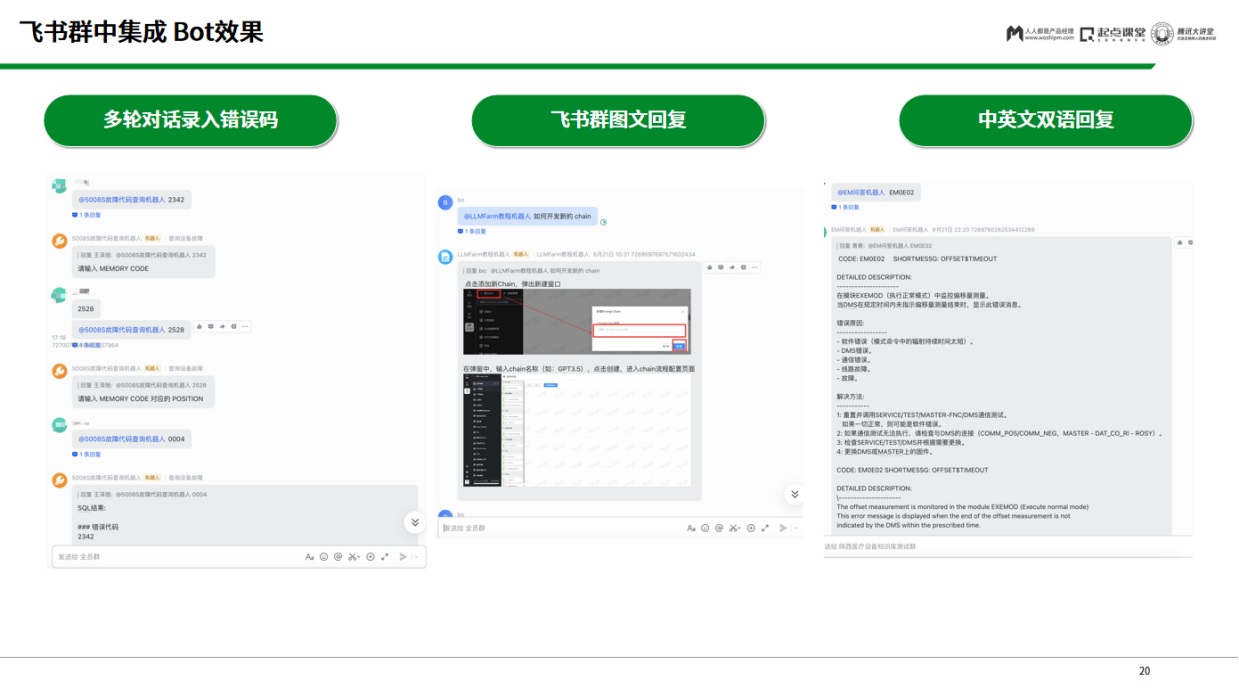

第三个案例,来自于医院医疗设备的维护厂商。原本的维护方式存在文档繁多、格式复杂、需要实时翻译、需要定位图文结果二次校验等问题。而我们的案例很好地解决了KMS知识库交互复杂的问题。

我们将各种格式、各种模态、各种语言的文档都传入向量数据库里,通过配置流程的方式形成。在使用过程中,机器人会先用多轮对话的方式,获得当前故障的多级错误码等信息。回复的结果通过图文等形式展示,自动翻译,并索引原文位置。

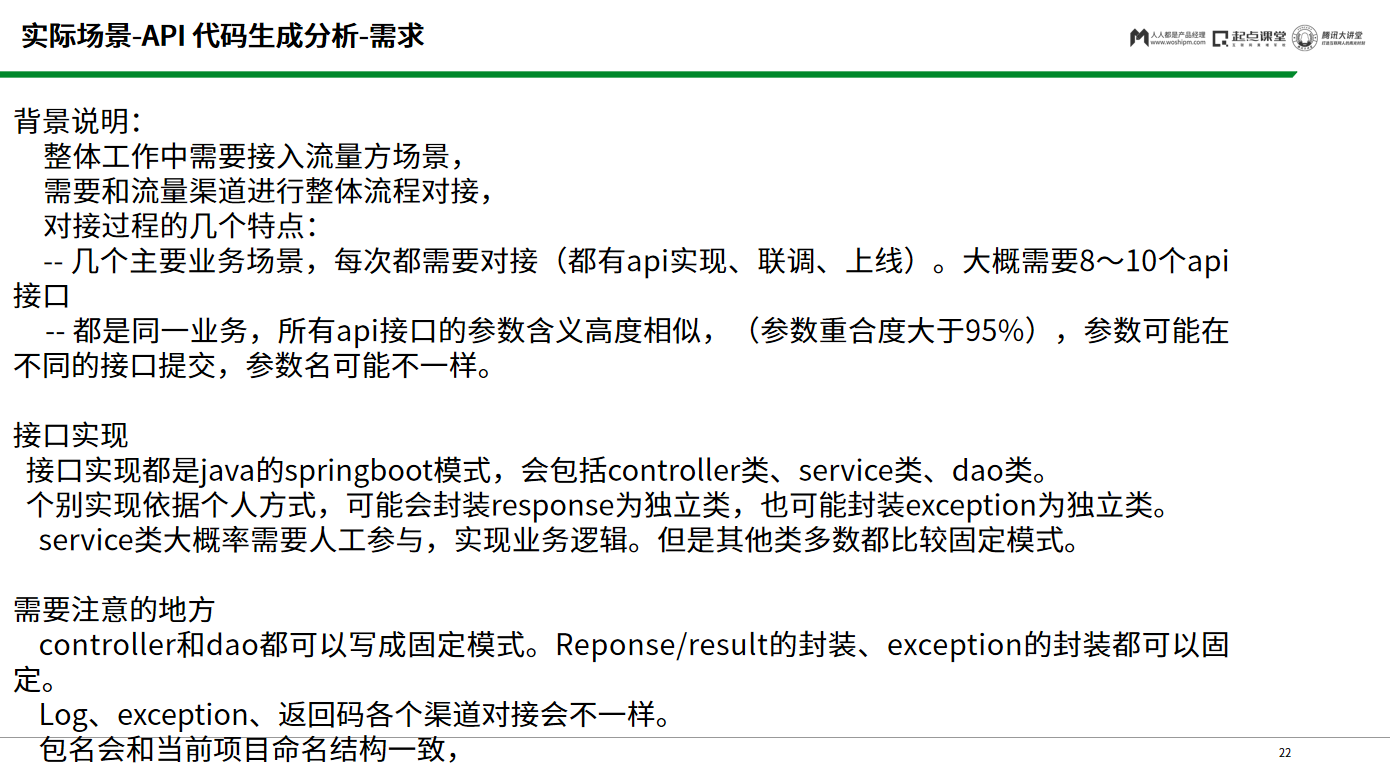

4. 某代码生成需求及落地

这个案例的需求来自于国内一个API厂商。针对一句话描述,生成一个代码片段,直接嵌入使用。

5. 工作流自动代码生成案例及介绍

通过自然语言描述一个工作流步骤,生成一个工作流,并可以马上执行。

6. ChatBI 人工智能报表场景及落地

ChatBI,是用自然语言生成报表,特别受到运营同学、产品同学以及老板的喜欢。因为老板看到的传统报表内容很有限,如果想看到额外维度的报表,所花费的时间可能要等产品技术同学做几天甚至一个礼拜,现在则一句话就能快速看到报表结果。

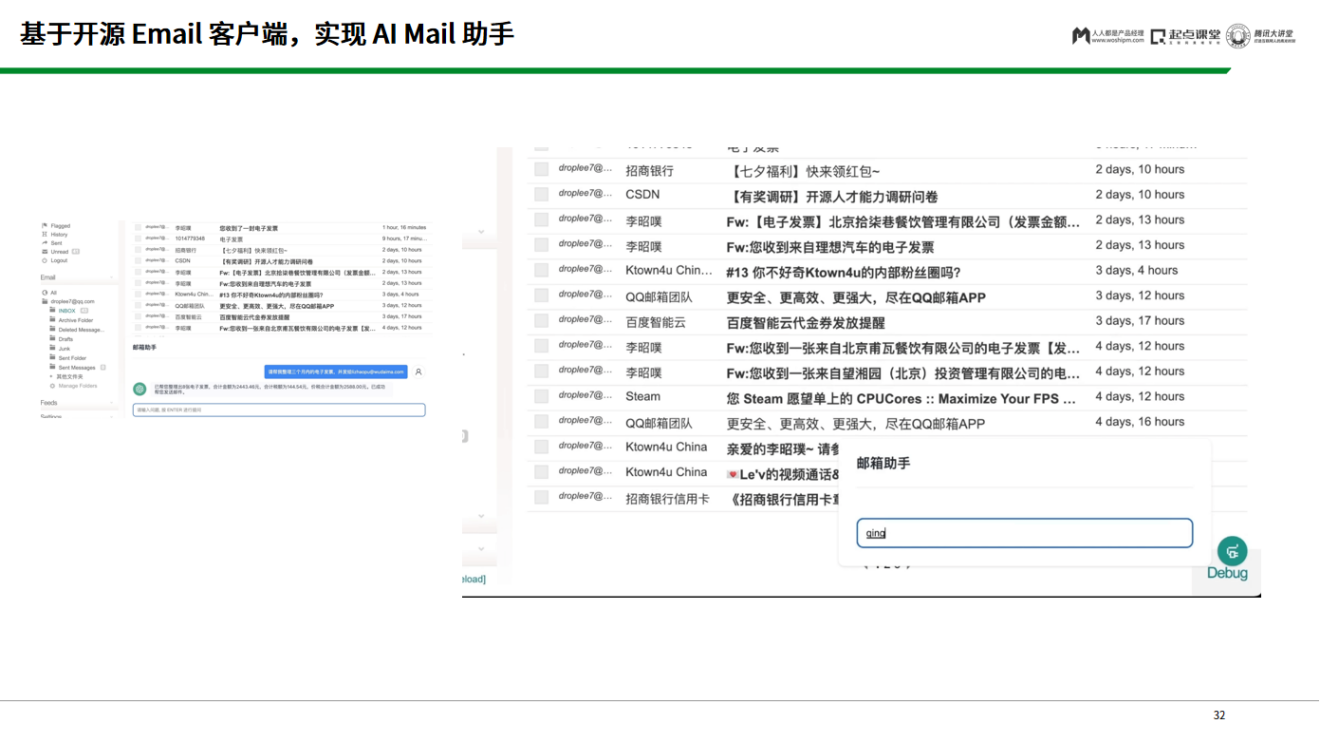

7. 电子邮箱AI助手:一句话整理电子发票并发送给财务报销

借助电子邮箱AI助手,你可以输入一句话对邮箱邮件做处理,可以做电子发票的附件整理,也可以做多轮对话,比如对和某一个客户之间的关系做分析和总结;电子邮箱AI助手甚至可以帮忙生成邮件话术。

二、了解GPT时代的底层逻辑

在了解完落地的案例之后,给大家介绍一下GPT时代背后的底层逻辑。

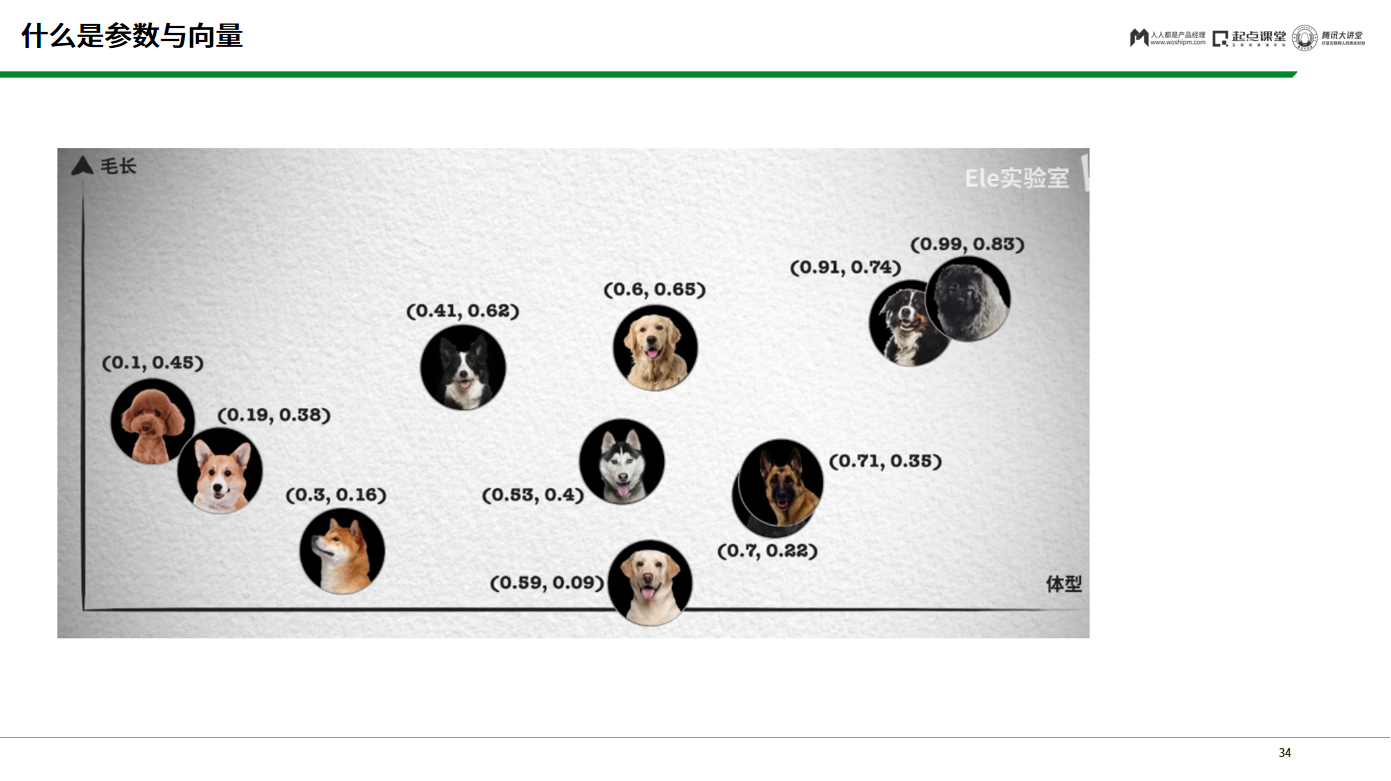

1. 什么是参数与向量

在传统IT系统里关键词搜索“狗”这个关键词,是搜索不到“金毛”这个词的。但在向量时代,“金毛”这个词有一个特征值是“类型”,“金毛”的类型是狗,所以当你搜索“狗”,便能够查到“金毛”对应的内容。

又比如,想找长毛的大型犬。由于向量数据库里记录了各种狗的毛长特征值、体型特征值,所以你可以搜索到结果。如下图所示,这就构成一个二维的特征空间,特征分别是毛长、体型,这里每一个特征值就对应是大模型一个参数。

现在“金毛”这个词在 GPT-3 里有 1750 亿个参数,也就是有 1750 亿个特征值。这个值是通过知识大量的文本关联和训练、神经网络多层的训练来得到的。GPT-4 共有 1.8 万亿个参数,GPT-5 号称有 100 万亿个参数,也就是说,一个词在 GPT-5 里未来会有 100 万亿个特征值。

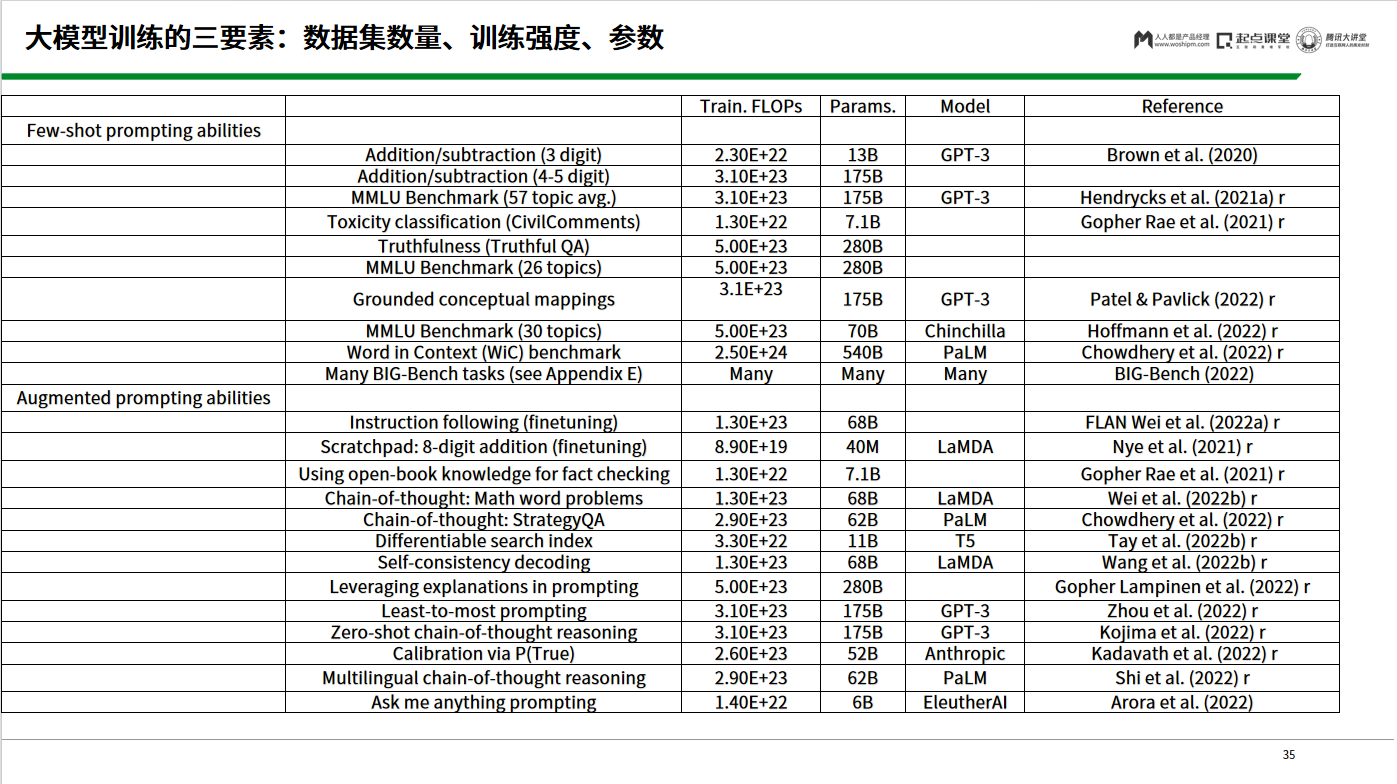

2. 大模型训练的三要素:数据集数量、训练强度、参数

大模型训练有三个要素。第一个要素是数据量,比如 GPT-3 有 45 个 TB 的数据集容量,也可以用tokens表示,比如 GPT-4 在约 13 万亿 tokens 上训练。第二个要素是训练强度,Train FLOPs,比如是 5E 的 24 次方。第三个要素是参数值,比如 13B,175B 等等。

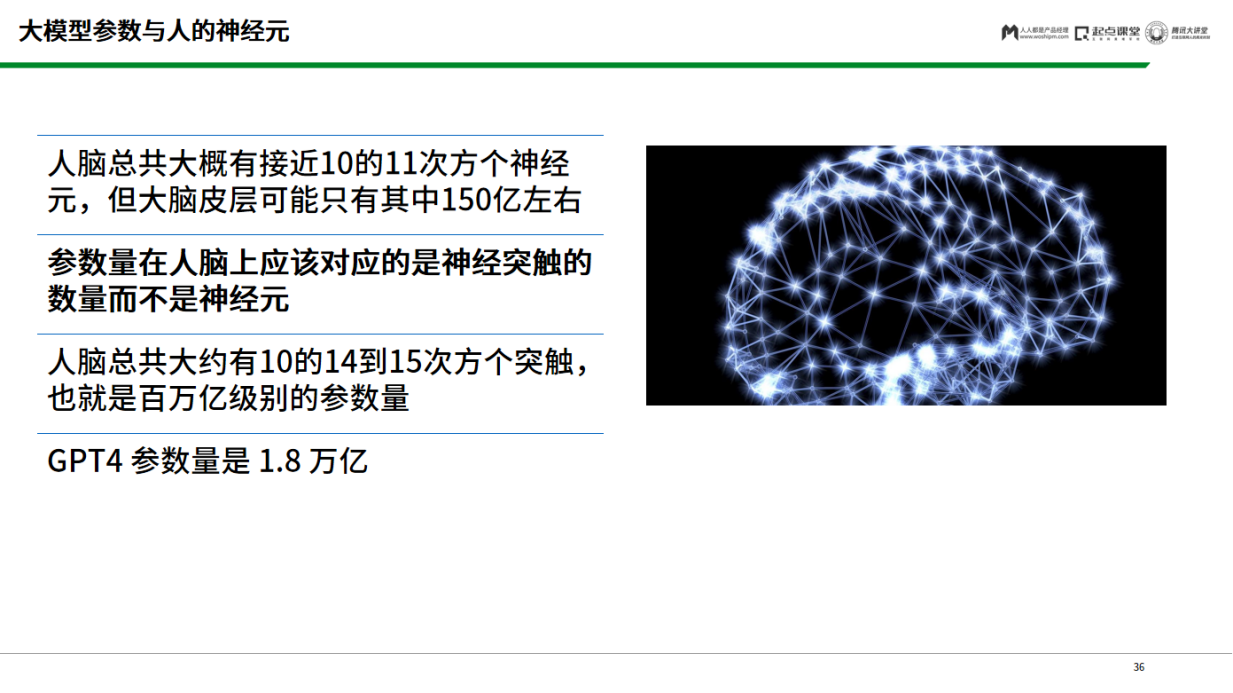

人的大脑大概有 150 亿个神经元,有大概 100 万亿的神经突触。人的神经突触对应的就是参数量,可以想见,GPT-5 的参数量将会和人的大脑的参数量基本一致。而现在 GPT-4 只有 1. 8 万亿,可以想象一下,明年的这个时候,我们世界又会来迎来一个很大的变化,因为 GPT-5 诞生了。

3. 大模型应用两种开发方式

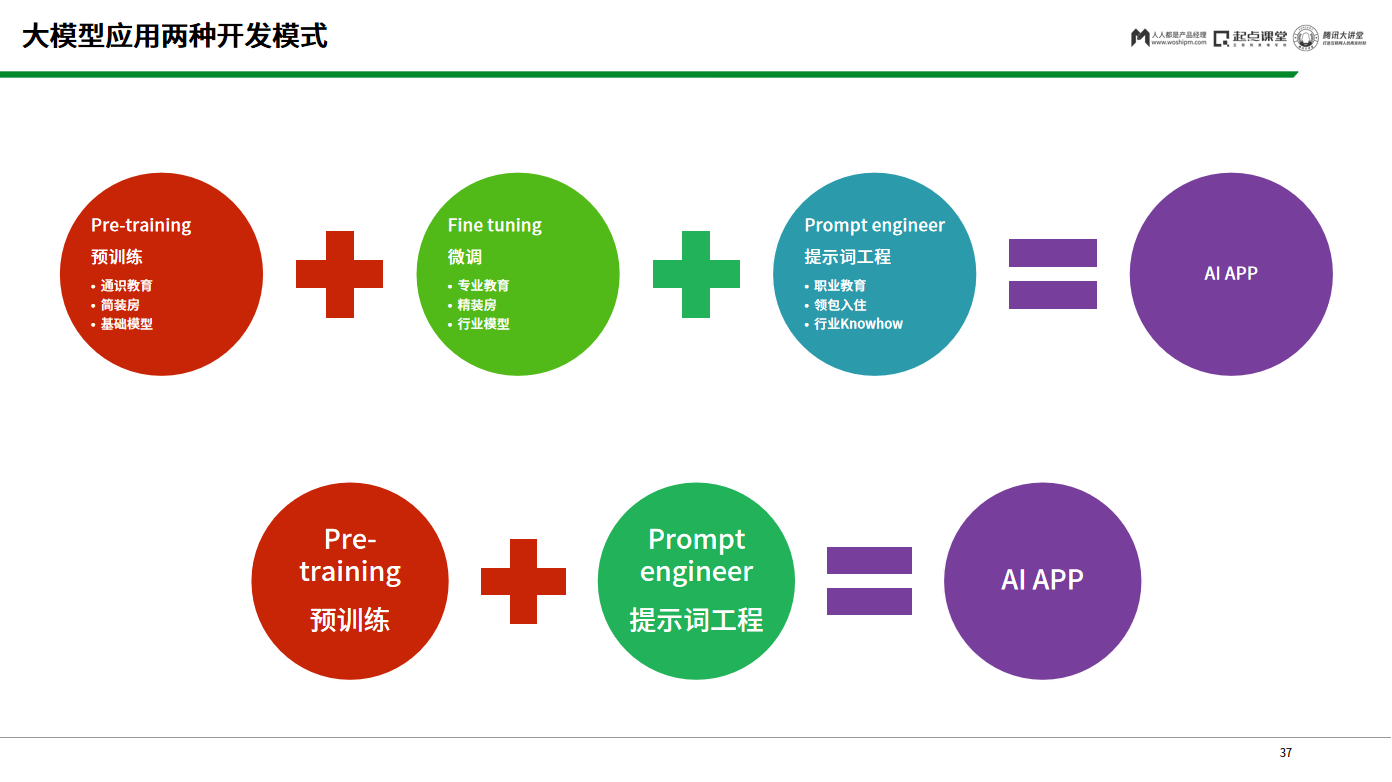

大模型的开发模式有两种。

第一种叫做 pre-training + fine tuning + Prompt Engineer。

通俗的理解是,pre-training,即通识教育,相当于现在有一个孩子,你要教他认字、学算数、做推理。这个步骤产生的是基础大模型。

第二个部分叫微调(Fine tuning),微调其实相当于大学的专业课,比如你是学法律的,你会接触一些法律的条款、法律名词;你是学计算机的,就会知道什么叫计算机语言。

第三个部分,是职业训练。假设一个法律学生大学毕业了,这个时候,他是不能直接去打官司的,他必须要经过职业训练,才能保证专业度。什么叫专业度?就是准确率。这个时候,AI应用的准确率要达到商用级别,也就是超过人的准确率,所以这需要 prompt engineer,这就是 PE 的重要性。

第二种开发模式,其实是可以绕过fine tuning去做PE,而后落地一个AI APP。有一个好的基础大模型,加上一个好的PE,就能做出一个好的应用。

4. 人机协同三种模式

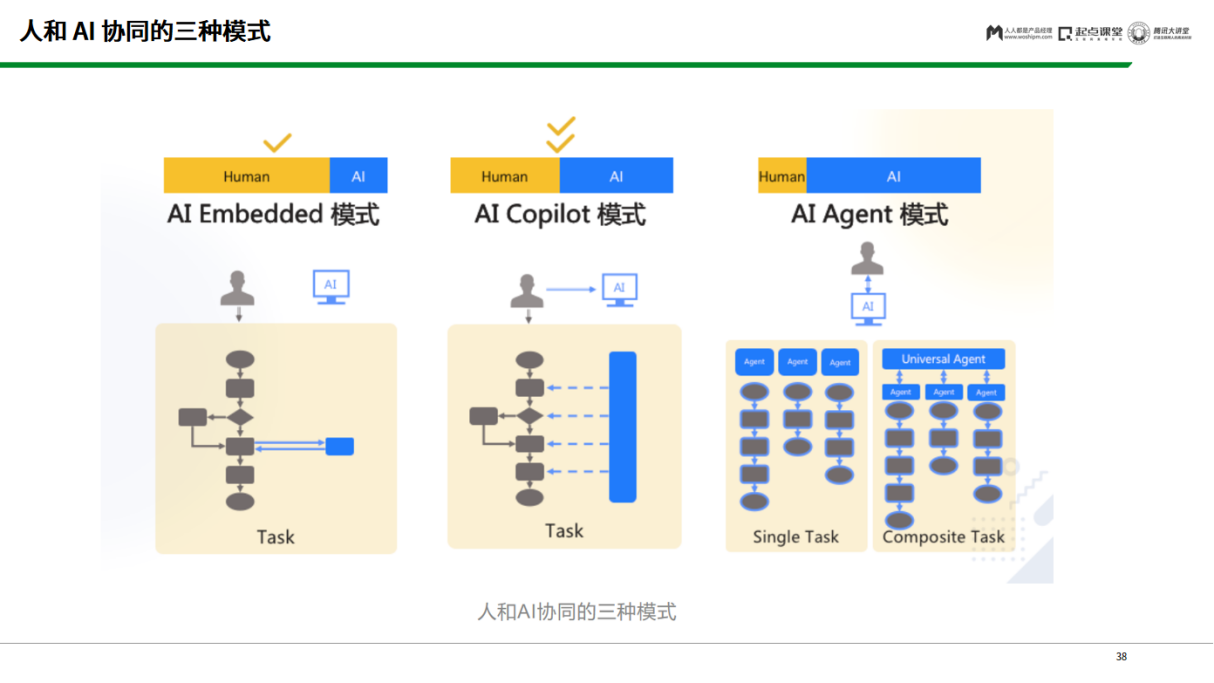

人机协同三种模式。第一种叫AI Embedded模式,在某一个环节里去调用大模型。第二种叫AI Copilot模式,每个环节都可以跟大模型进行交互。第三种是AI Agent模式,任务交给大模型,大模型即可自行计划、分解和自动执行。

5. 现在预训练,微调一个大模型需要多少成本

3 月份的时候,训练一个GPT-3. 5大概需要 1200 万美金。但是最近英伟达新发布的数据,HGX A100 用 4000 个GPU,在4天里训练出 175B 的大模型;如果用 HGX H100 的话,则只需要一天,其效率比 HGX A100 了四倍,成本降低了十倍以上。所以未来训练模型的成本会越来越低,而模型会变得越来越大。现在大家自己做一个 6B 的小模型,或许人民币几百万即可搞定,而这放在 3 月份的时间节点,只会让人觉得不可思议。

6. ChatGPT的历史

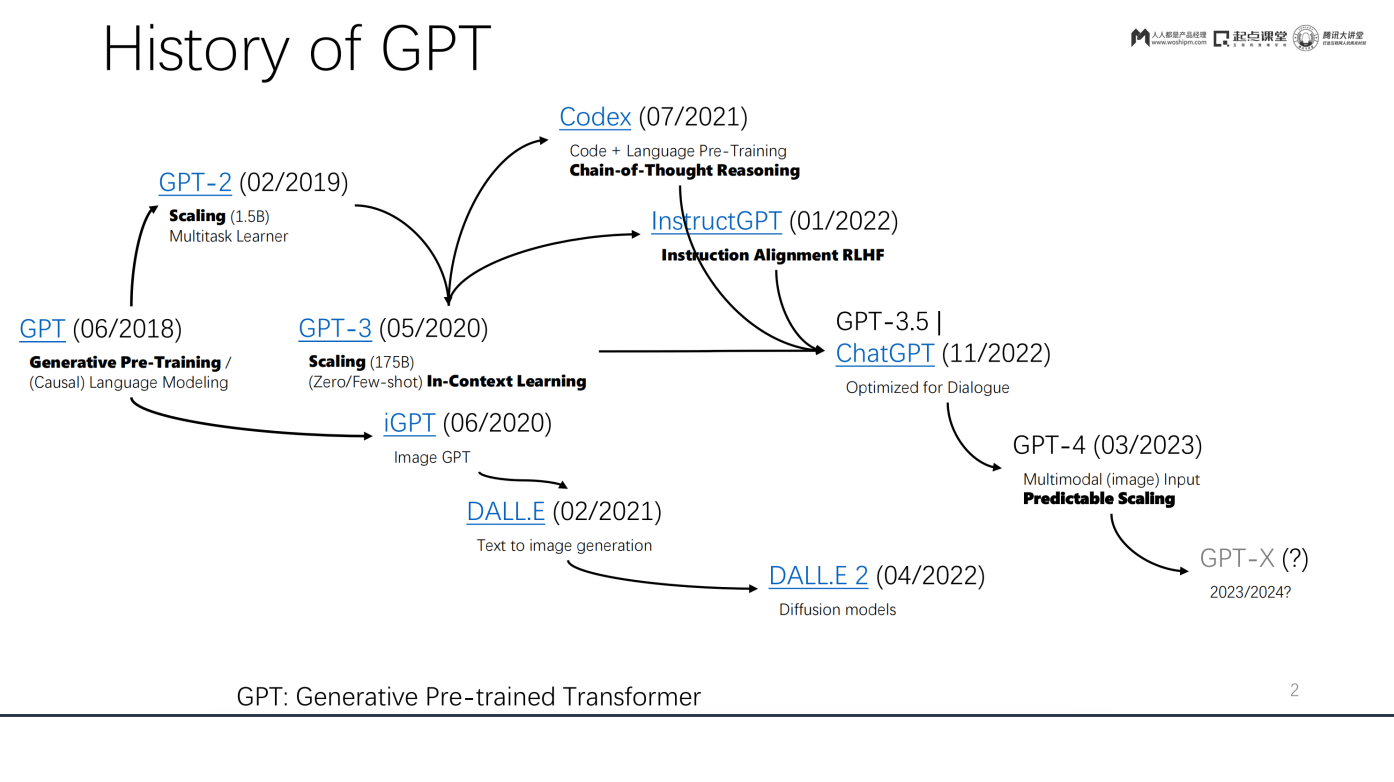

ChatGPT 的发布引爆了时代,而背后可以归溯到 GPT-3,GPT-3是一个重要节点,因为GPT-3出现了涌现能力,比如上下文学习。Codex 涌现出一个能力叫 COT思维链,随后InstructGPT有了人类反馈学习,接着再有ChatGPT、GPT-4 等。

AGI 是 General AI 通用人工智能 ,如何理解 AGI 的核心?我打个比方,AGI 就像会72变的孙悟空。以前牛魔王需要训练很多妖精去组成一个军队,一个蛇精需要修炼300 年,一个熊精需要修炼500年。而现在有个基础大模型,它会72变,拔一把猴毛,吹一口Prompt,就可以幻化出天兵天将,这就是通用大模型。

7. 涌现

GPT-3 开始发现有涌现能力,这区别于以往人类历史上的所有模型,涌现里有很重要的一个能力,叫“知识推理”,涌现是指系统的数量变化导致行为的质量变化,像计算、翻译、上下文学习、思维链等,都是涌现能力。

没有涌现能力的大模型都是复读机。若要有涌现能力,参数值的数量是必要非充分条件,比如上下文学习能力,没有100b的参数值,是不可能出现涌现的。但是你的模型有了100B的参数,却不一定能有上下文学习涌现出来。

GPT-4拥有了更多的涌现能力,它能做情绪感知,能读懂幽默,看懂人类的笑话,能在没训练过的情况下,用图形画出一个独角兽。这就是GPT-4涌现出的能力,包括音乐、代码、数学、具身交互、解释行为、情绪感知等。

8. 大模型奇点

西方宗教里,亚当夏娃偷吃了“知识之果”,开始学会知识推理,进而学会万事万物。我们现在创造的大模型,它具备了知识推理能力,相当于已经“偷吃”了知识之果,未来可能我们人类能控制大模型的只剩下拔电源,这也是不少西方人对其感到恐惧的原因。

在陆奇的观点里,人类掌控环境通过三个步骤,感知、思考、实现。对应信息、模型、行动。信息化就是信息由系统实现,模型和行动还由人来实现,数字化就是信息和模型都由系统来实现,行动由人来实现,比如抖音里你看什么内容已经不是人决定的,是模型,你只有决定看不看、看多久、划不划走的决定权。而智能化时代,我们进入了全新的范式拐点,信息、模型、行动都由系统来实现了。

所以未来十年,最重要的能力是学习使用大模型。

三、熟悉LLM时代Prompt Engineer开发范式

第一层:简单Prompt的例子

即编写一个提示词(Prompt)去调用大模型,这是最简单的形式,这里就不多赘述了。

第二层:Plugin

也就是用大模型插件(Plugin)去调各种API。

第三层:Prompt Engineering Workflow + OpenAI API

基于提示词工程的工作流(workflow)编排。上文提到的AI应用就是基于工作流实现的。以ChatBI为例,通过编排工作流,定义如何获取数据库结构、如何写Prompt、如何调大模型,实现全部自动化。只需要输入一句话,就能沿着工作流自动执行,输出结果。

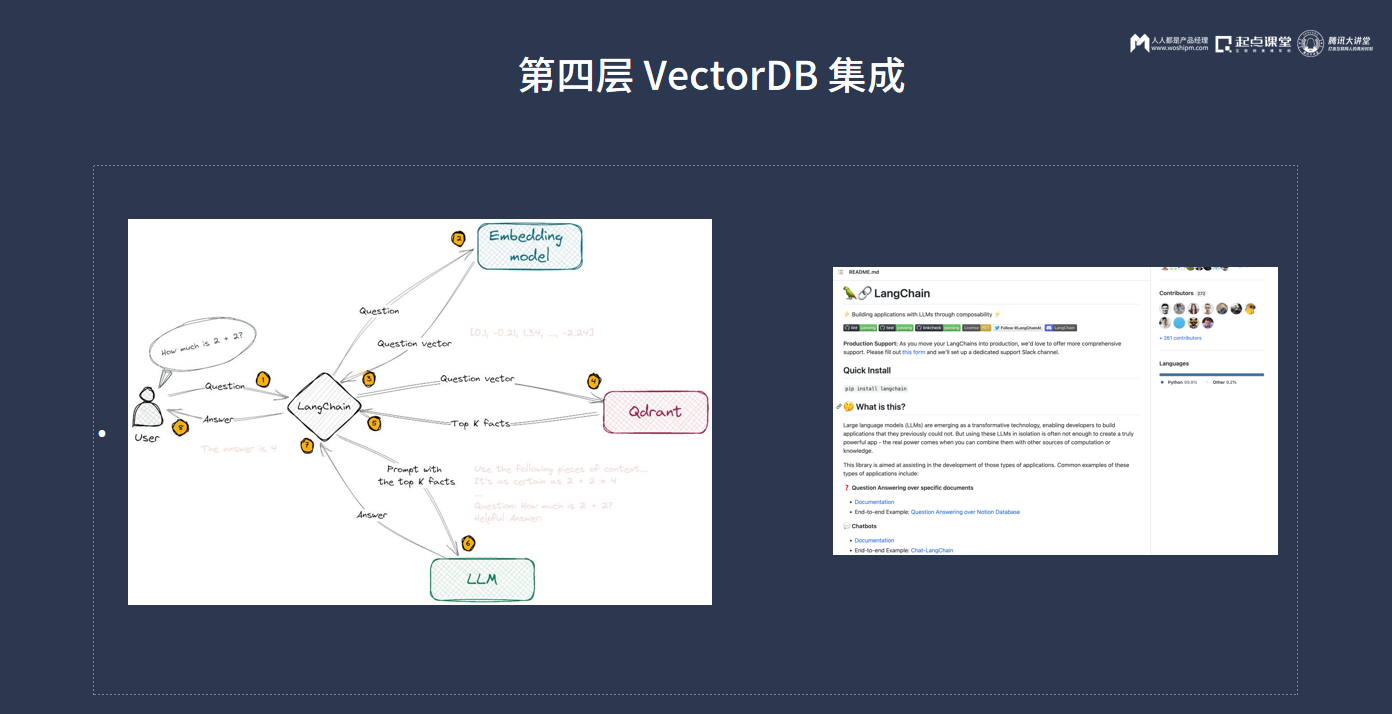

第四层:VectorDB集成

VectorDB包含着数据的特征值,现在最好的AI应用落地方案就是VectorDB,包括做知识库、做客服机器人,这些都是VectorDB的应用。

第五层:AI Agents

现在这个概念特别火,最重要的逻辑就是让大模型自己做递归。AI自己对任务进行拆解,再进一步递归、继续拆解,直到有一步,AI可以将这个任务执行,最后再将任务合并起来,往前递归回来,合并为一个工程。这就是Agent的原理。

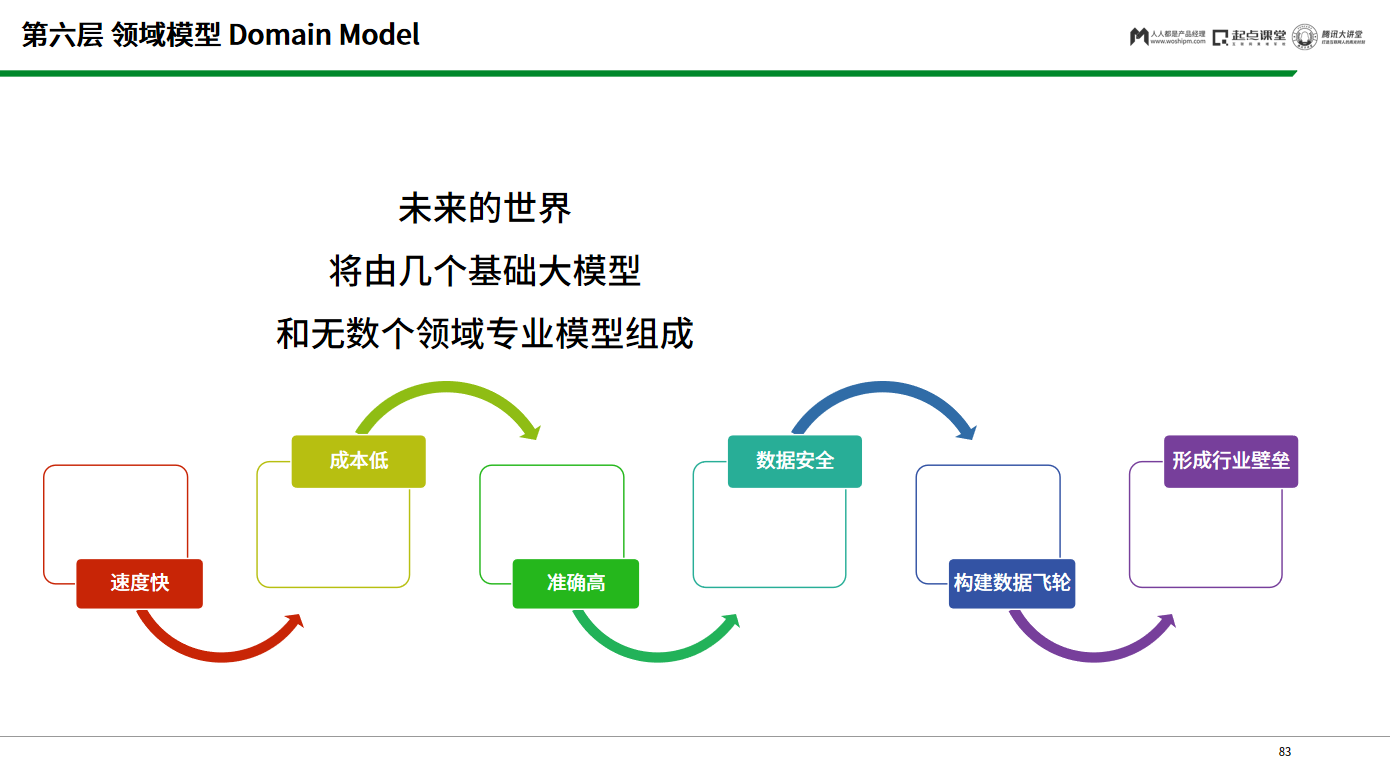

第六层:领域模型Domain Model

专业模型为什么重要?大参数的基础模型的训练和推理成本是非常高的,而专业模型速度快、成本低、准确率高,因为你有行业的高质量数据,所以准确率高;进而可以形成数据飞轮,形成自己的竞争优势。

未来这个世界一定会由几家大模型公司,再加上每家公司都得有自己的小模型,如果你的公司没有小模型,那么你的公司将没有存在价值。

四、可视化LLMOps助力AI创业10倍降本

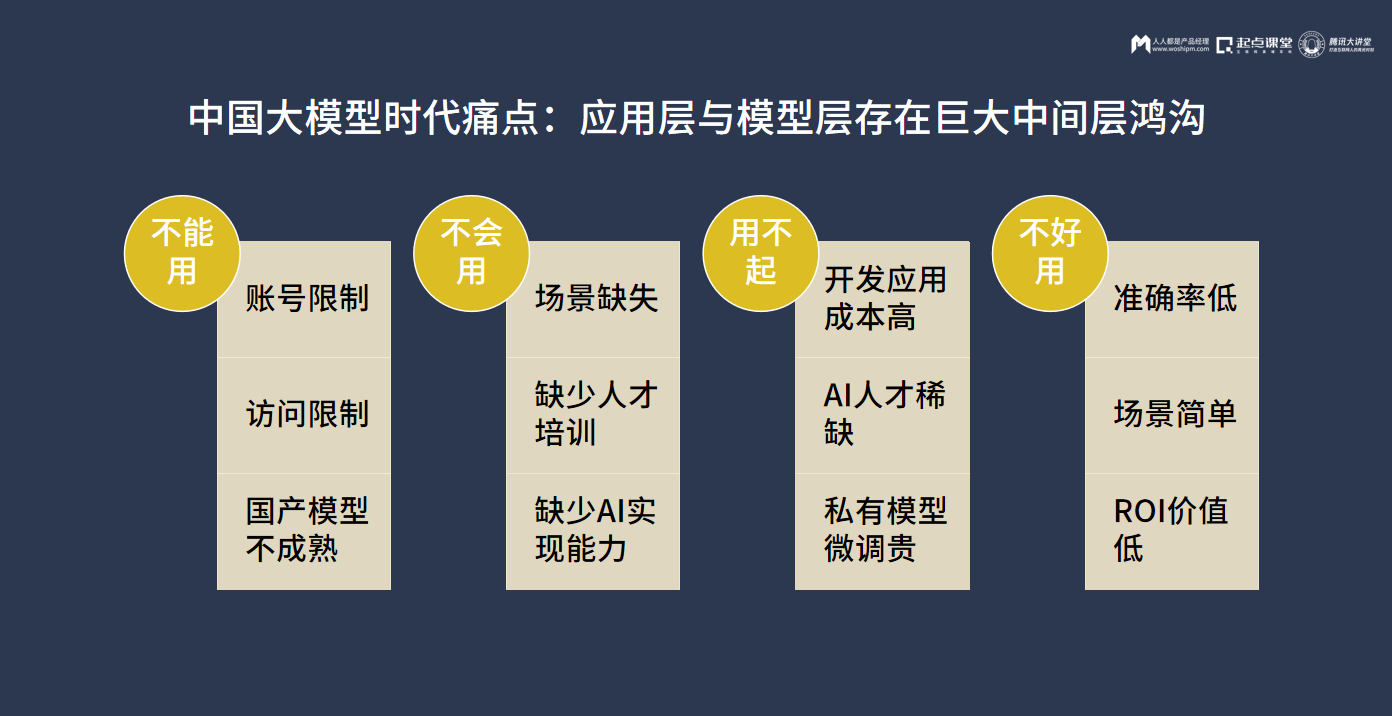

1. 中国大模型时代痛点:应用层与模型层存在巨大的中间层鸿沟

现在的大模型时代存在很大的问题——不能用、不会用、用不起、不好用。

这也是我们做开发范式中间层框架的原因。我们做了500+机器人模板市场,模板下载开箱即用,也对接各类国内外大模型API,支持私有部署各类开源大模型,同时用户可以定制Prompt Chain开发,三步可视化配置,相当于做了一个无代码版的 LangChain。

可以这么理解,产品经理可以在不需要任何编程的情况下把流程 workflow 搭建出来,搭建出来之后,产品经理可以把系统再集成到任何一个产品里。

我们也用 API 的方式将它集成在了各个 IM 里,在 IM 里加一个机器人,即可以变成一个新的小程序或者APP。所以在不需要算法工程师、不需要前后端工程师的情况下,我们可以在很短的时间内开发想要的 AI 应用。

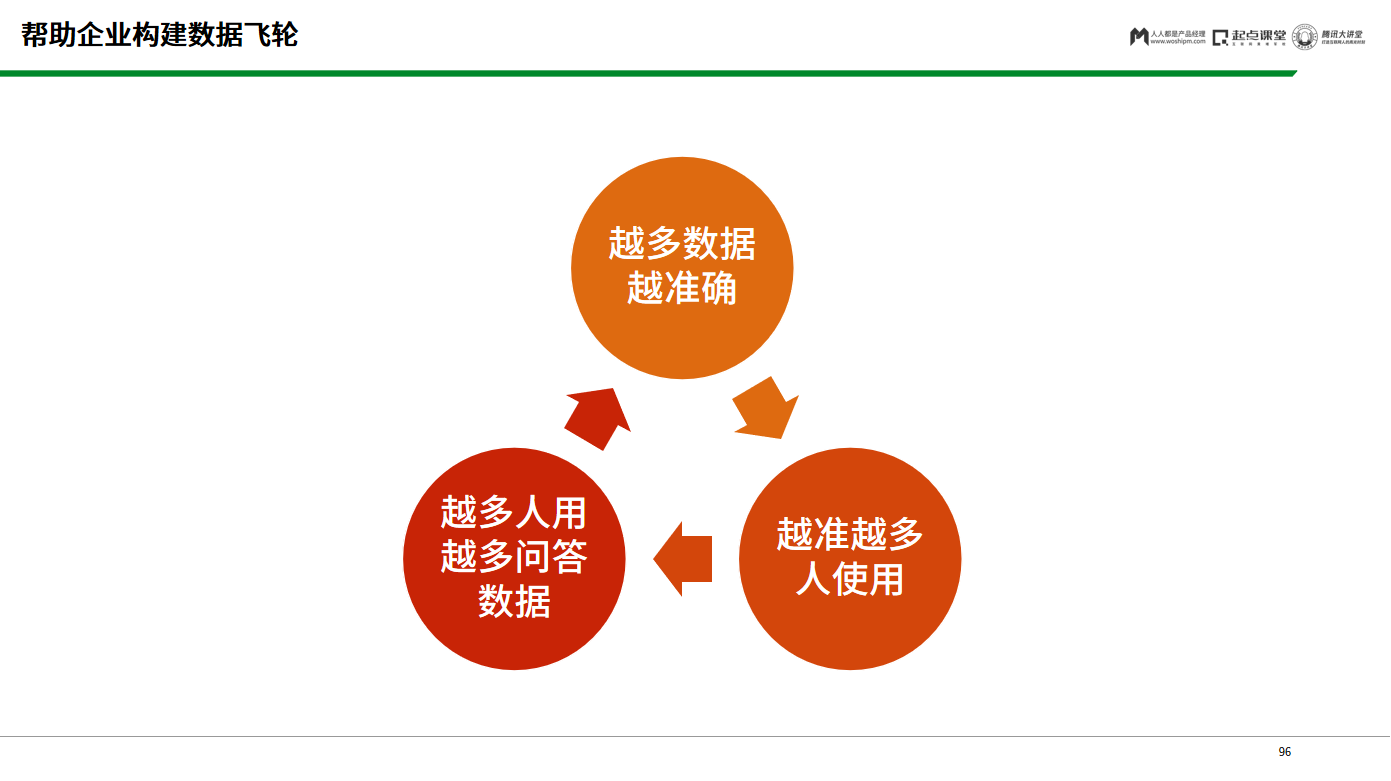

我们想帮助企业构建数据飞轮。当有越多数据时,结果就会越准确;当结果越准确,就会有越多客户选择使用;当有越多客户使用,我们就可以积累更多的高质量问答数据。这些问答数据一定要保存好,这是你未来的立命之本。

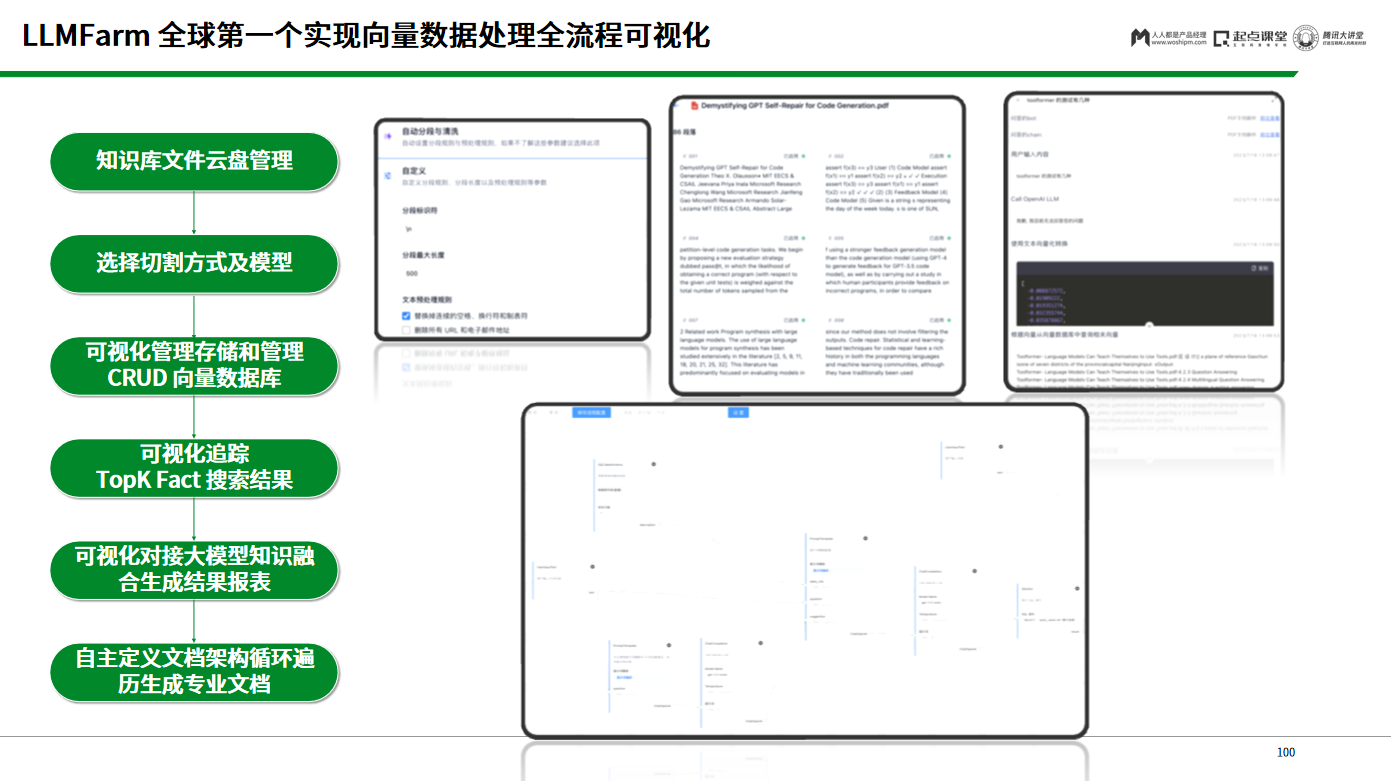

2. 向量处理全流程可视化

怎么处理向量?一般分这几步——知识库文件云盘管理、选择切割方式及模型、可视化管理存储和管理CRUD 向量数据库、可视化追踪TopK Fact 搜索结果、可视化对接大模型知识融合生成结果报表和自主定义文档架构循环遍历生成专业文档。

五、 AI First第一性特性挖掘创业机会

AI First就是AI的第一性原理。在移动时代,08 年、10 年出现 iPhone 和安卓的时候,你有想过 Mobile first诞生了什么应用吗?当时是无法想象的。类比到今天也是如此,今天ChatGPT诞生了 ,你同样无法想象 5 – 10 年之后,这个世界会被 AI 改变成什么样子。

什么叫 AI first?AI 的第一性原理特性又是什么?我给大家总结了 5 条。

1. 对话文本

第一,泛化的文本对话能力;在此之前,所有的AI没有办法做角色扮演,也没有办法用一个AI去生成多种文档,不能做到既生成文本、又生成代码。

2. 向量处理(非结构化文本数据)

第二,向量处理;以前我们只能一一搜索,现在可以特征搜索。以前你需要将文档打标签结构化,现在只需要上传并切割存储就可以使用了。

3. 数据分析(非结构化数据、归因分析、算法分析)

第三,非监督的数据处理;以前的数据处理需要人去将数据归因出来、算法归因出来才能做处理。现在有了大模型,可以自动根据数据得到数据建模或者规则,进而自动开发出来软件,也可以直接对数据做归因分析。

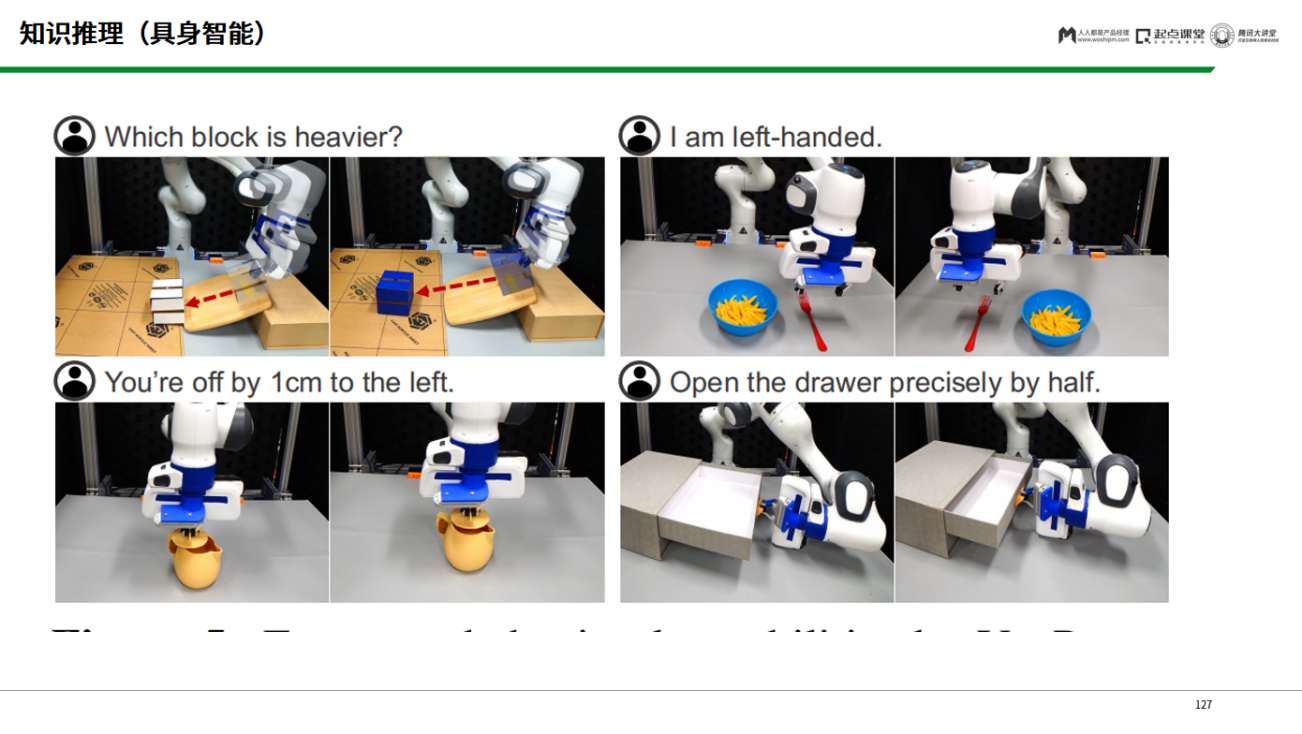

4. 知识推理(具身智能)

第四,知识推理,也就是能够将智能搭建为可行动的系统。我们可以看李飞飞老师在论文中举的例子。

我们可以对机器人说一句话,比如把垃圾放到蓝色的盒子里,把面包放到烤面包机里,或者打开维生素瓶子,这些语句机器人都能识别并执行。比如询问两块砖块哪个更重,它会自己去进行规划,搭建一个台子,看看哪个砖块滑得更远;又或者我想把抽屉打开一半,机器人会把抽屉先全部拉开,测量到全距离后,再计算一半的距离,然后再把它合上一半距离。

5. AI Agent

第五,AI Agent。你可以用AI幻化为多个智能体,甚至能让AI讨论出一个具体的方案。

六 、如何迎接这一次创业浪潮

最后聊聊我个人对这次的创业浪潮的理解。

观点1:未来的创业机会在中间层

首先,未来创业机会一定在中间层。美国已经没有大模型的机会了,国内可能还有,但是机会也已经不多。

为什么不在应用层?因为应用层特别薄,只剩下 Chat UI 了,不需要你再去做设计界面等复杂的东西,它只有一个 Chat UI。但 UI 背后的部分是需要大家好好去设计的。

另外,应用层不是指应用本身,现在能实现端到端的应用应该是我们创业最大的方向。

观点2:Chat+是一种新的计算平台革命,所有行业都适合被改造一遍,也会诞生新的硬件平台

第二,我们会有一个新的硬件平台,可能是耳机、眼镜等,然后这类硬件平台可以用来替代手机。很快在未来,我们就能看到。

观点3:大机器人时代的来临

第三,大机器人时代来临,或许LLM+成为机器人会从功能性进化到智能的底层OS。通用机器人加上通用大模型,可能彻底地改变人类的生产力方式。我在3月份曾经预测过,特斯拉推出了通用人形机器人,一定会自己做一个通用大模型。果不其然成立了x.ai。

此外,在未来,什么领域不会被GPT-X折叠?个人觉得首先,非虚拟的;其次,拥有私有数据和隐私数据的;再者,会念Prompt咒语的;最后,一定要有自己的专业/领域模型。

我们常常听到这类表述,人间一天, AI一年。创业者到底要怎么做,是我们亟需思考的问题。

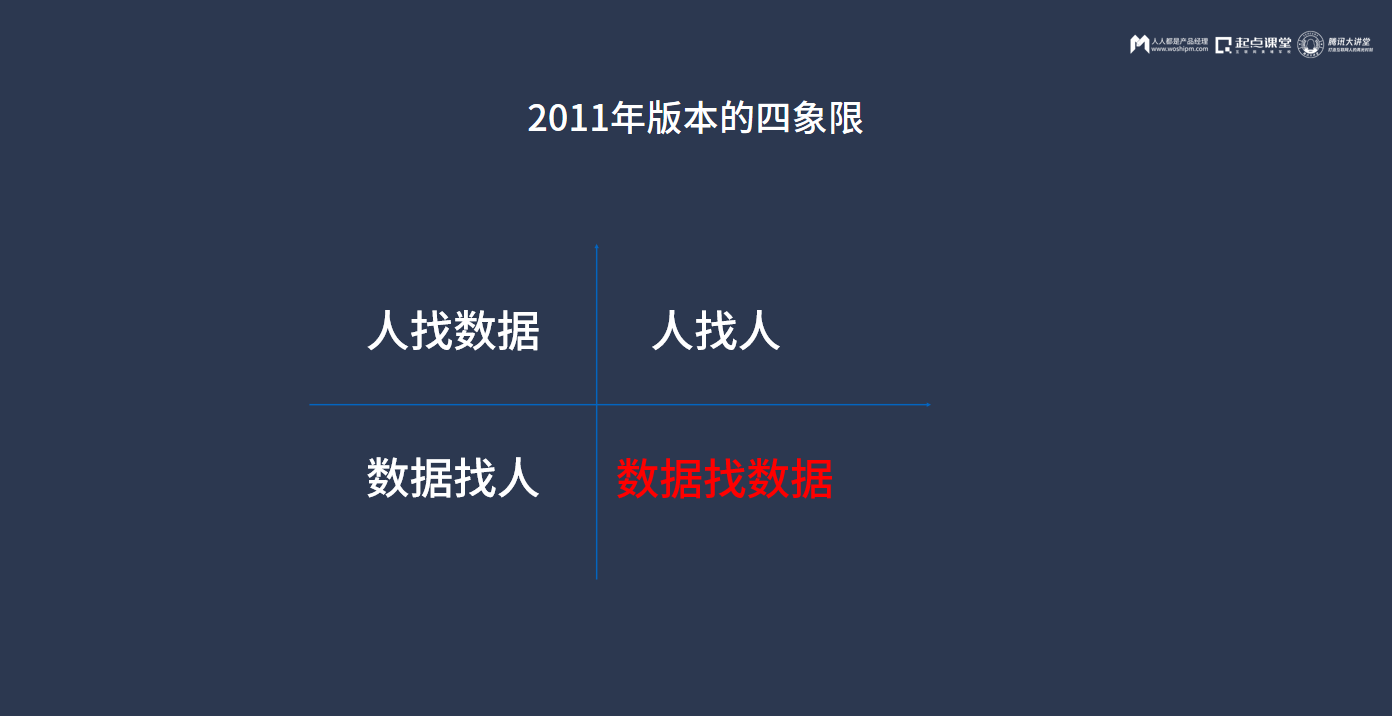

2011年我曾经画过这张图预测,每个象限里会都会诞生伟大的公司,人找数据诞生了谷歌和百度,人找人诞生了 Facebook 和微信,数据找人也一定会诞生,只是那个时候不知道什么,现在来看就是字节跳动的推荐算法。今天看到的,数据找数据,其实就是大模型。

这里再分享几个Sam Altman的观点。

“一个全新的摩尔定律可能很快就会出现,即宇宙中的智能数量每18个月翻一番;”

因为AI被应用于劳动力中,“住房、教育、食物、衣服等,每两年就便宜一半。”

正如黑格尔所说,“人类都是带着恐惧和希望共同走进未来。”希望大家活在当下,做自己能做的事情。悲观者永远正确,乐观者永远前行。

大会直播回放

目前大会回放已上架,戳此购买,即可收看回放:https://996.pm/7gX2B

本文为【2023年产品经理大会(北京站)】 现场分享整理内容,由人人都是产品经理智囊团@左迁 整理发布。未经许可,禁止转载,谢谢合作。

题图来自大会现场

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

起点课堂会员权益

起点课堂会员权益

产品经理的职业发展路径主要有四个方向:专业线、管理线、项目线和自主创业。管理线是指转向管理岗位,带一个团队..

产品经理的职业发展路径主要有四个方向:专业线、管理线、项目线和自主创业。管理线是指转向管理岗位,带一个团队..

文章写的很全面,这里提一个可能存在的刊误:““金毛”这个词在 GPT-3 里有 1750 亿个参数,也就是有 1750 亿个特征值。”,单个词不可能有1750亿个特征,transformer貌似最大是512维

文章写的很全面,这里提一个可能存在的刊误:““金毛”这个词在 GPT-3 里有 1750 亿个参数,也就是有 1750 亿个特征值。”,单个词不可能有1750亿个特征,transformer貌似最大是512维

悲观者永远正确,乐观者永远前行。

数据找数据