“诈骗”“AI换脸”“一键脱衣”,人工智能的另一面到底有多黑暗?

生成式AI爆火之后,AI的应用就让大家目不暇接。但如果是用在工作、生活中还好,如果是用来做一些不合适的事情,现有的法律和准则,似乎很难约束。这种情况下,AI是在助纣为虐吗?

从去年开始,AI行业不厌其烦地上演着“iPhone时刻”,比如ChatGPT的人机交流、HeyGen让老外说中文、Runway的化静为动等,AI舞台的中间正在成为各方争霸的焦点。

但与此同时,在这些AI应用的反面也在上演着一场“蝴蝶效应”带来的“灾害”。

比如,看似普通的AI换脸,从明星、总统,影响到白领职员、学生在内的每一个普通人,它没那么惊艳也不算颠覆,却足以让我们“心惊肉跳”。而“一键脱衣”应用的出现更让人们的安全感荡然无存。

是什么样的人在利用这些应用来作恶?他们就无法无天了吗?难道这就是AI为人类带来的价值吗?

人工智能在助纣为虐吗?

我看到你的“裸照”了。

如果有一天,你如往日一样坐地铁上班或者骑车上学,在座位上准备一天的工作或课程时,朋友发来一条“我看到你的裸照了”的信息,你会有怎样的反应?

这不是一个玩笑。

此前,在仅三万人居住的西班牙阿尔门德拉莱霍(Almendralejo),一个话题正在以“病毒”似的速度传播着,网上有学校里三十多名女孩子们的裸照。更令人感觉到可怕的是,这些女孩们明明是受害者,但在这个小镇里,却并没有得到邻里们的支持。

在可想而知的黑暗中,他们在家人的支持下,坚持了下来,直到警察公布了犯罪嫌疑人的信息,才让风波平息,但罪恶的背后却让我们看到了AI的阴暗面。

西班牙国家司法警察总署就对此案作出了一些解释和报告:涉案人员总共有十人,其中三人使用了ClothOff,这是一款免费的人工智能应用程序,它可以让用户“脱掉”任何想要的人的衣服,这也意味着任何人都可以通过这样一款AI应用,以极低的成本来实施犯罪。

这样的罪责并没有让技术有所收敛,而是以更快地速度在发展。

在我国也同样出现了这样的案例,一位广州女生在地铁拍的美照,被个别网友,用AI一键脱衣软件生成了裸体照片。更可恶的是,在AI脱衣处理以后,还有网友就把生成好的裸照发到各个微信群,继续进行造谣,这对于当事人造成了不可忽视的影响。

不仅是普通大众成为受害者,美国流行乐歌星泰勒·斯威夫特也受到“AI伪造照片”事件的困扰,大量由AI生成的泰勒虚假色情、血腥照片在多个社交平台疯传,浏览量已超过千万,引发社交媒体震动,也引起了美国白宫的注意。

实际上这不是泰勒第一次成为AI“深度伪造”的受害者。就在不久前,有人使用AI技术仿造了她的声音和形象来为商品进行推广,让消费者误以为这是泰勒代言的商品。

元宇宙新声认为,虽然利用AI技术制作虚假信息早已有之,但随着生成式AI在过去一年多时间内的快速发展,对视频、图片、音频进行深度造假技术更加成熟且普遍,造假的成本也更加低廉。

传播学者罗伯特·切斯尼形象地称之为,“说谎者的红利”,前所未有的AI深度伪造焦虑让那个曾经遥远的问题,骤然变得现实而紧迫。

那么,这些令人发指的行为应该如何处理?在这个真假难辨的时代里,普通人就应该成为受害者吗?

AI的阴暗面,难道没办法阻止吗?

使用人工智能算法生成的高度逼真的虚假图像、音频和视频等,被称为“深度伪造”内容。

这一概念于2017年首次出现,此后借助该技术诈骗或操纵舆论的事件在全球愈加频发。以美国为例,过去一年里人工智能诈骗事件同比增幅超过了50%。

不过时至今日,人们仍未能有效解决该问题。这是因为人工智能造假能力的进步速度远远超过了信息识伪技术的开发速度。

如今,任何人都可以快速地、低成本地生成难辨真假的图像、音频甚至视频,而且难以追踪。与之相反,识伪技术则因在主题和软件方面具有特异性,难以得到普及。此外,核查事实需要花费更多时间精力。

据日本瑞穗研究所及技术公司的调查,70%的日本受访者认为互联网上的信息很难判断真假,但只有26%的受访者表示在接触可疑信息后会进行某种程度的验证。

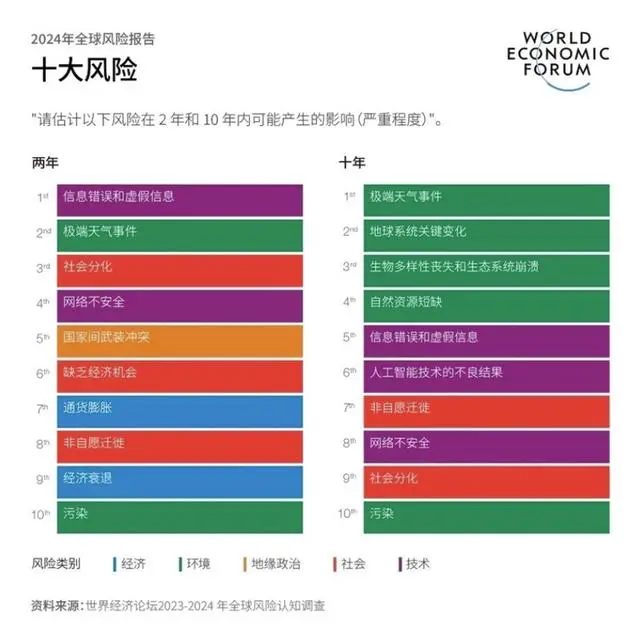

2024年年初,世界经济论坛发布《2024年全球风险报告》,将人工智能生成的错误信息和虚假信息列为“未来两年全球十大风险”之首,担心其会使本就两极分化、冲突频发的全球形势进一步恶化。

元宇宙新声发现,很多的AI深度伪造说不清究竟是分辨不清,还是半推半就,深度伪造的信息总是能在“看热闹不怕事儿大”的心态下广泛传播。

立法是治理AI犯罪的一种途径

我们看到,2016年以来,各国陆续发布相关政策法规,但进展仍赶不上技术的进步。去年10月,拜登签署美国首项人工智能监管行政令,为人工智能建立安全和隐私保护标准,但被指缺乏强制执行效能。

欧盟方面,虽然欧洲议会于3月13日通过《人工智能法案》,但是法案中的相关条款将分阶段实施,部分规则要到2025年才生效。日本执政党自民党直到最近才宣布计划在年内提议政府引入生成式人工智能立法。

近年来,我国也出台了《关于加强科技伦理治理的意见》《互联网信息服务深度合成管理规定》《生成式人工智能服务管理暂行办法》等多项法规和政策,一方面给AI有关技术的创新发展“鼓劲儿”,一方面又给其“立规矩”“划红线”,以确保相关技术的开发和使用遵守法律法规、尊重社会公德和伦理道德。

无论是生成式人工智能带来的虚假信息问题,还是人工智能应用的风险,其影响都是跨越国界的。因此,人工智能的监管和治理应通过国际合作来解决,各国应共同做好风险防范,携手共建具有广泛共识的人工智能治理框架和标准规范。

元宇宙新声认为,AI技术作恶确实值得焦虑,但也无须过虑。如同时代的发展,人类社会也在自我调节中不断适应着新的变化,新技术短时间打破平衡,很快在社会的自我调节下恢复平稳。归根结底,无论是“AI换脸”还是“一键脱衣”,错都不在AI,也不在技术,而法规的制定也只是让罪恶发生时有法可依。

其实,真正可怕的从来都不是AI深度伪造,而是深度伪造的病毒式传播,而传播关乎我们每一个人。

写在最后

巴菲特曾比喻说:“我们就像是让精灵从瓶子里跳出来,尤其是当我们发明核武器的时候,它已经造成了一些负面后果。这种力量有时会让我感到害怕,而且这个精灵已经无法再放回瓶中。”

AI的情况可能与之类似,它已经释放出来,并一定会在各个方面发挥着重要作用,我们只希望这个作用更多地是正面的。

作者:贾桂鹏;公众号:元宇宙新声

本文由 @元宇宙新声 授权发布于人人都是产品经理。未经许可,禁止转载。

题图来自Unsplash,基于CC0协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益