AI统治人类,需要分几步走?

关于“AI大模型有可能威胁人类”的论调越来越多地出现在大众视野,就连“AI讲师”周鸿祎都在最近的社交平台上大谈AI灭世论,将AI焦虑拉到极致。可OpenAI作为AI时代的领头羊,面对舆论,依然没有对AI安全提高重视,甚至解散了安全部门。

你敢相信?ChatGPT已经通过图灵测试了!

甚至不是最新的GPT-4o,老版本GPT-3.5和GPT-4就已经打破人类和AI的最后一层限制。

“图灵测试”由计算机科学家艾伦・图灵在1950年提出。他将人工智能给出了一个完全可操作的定义:如果一台机器输出的内容和人类大脑别无二致的话,那么我们就没有理由坚持认为这台机器不是在“思考”。

“图灵测试”和“机器人三定律”,一直被人类世界视为保护人类的最后屏障。

就连“AI讲师”周鸿祎,都在最近的社交平台上大谈AI灭世论,将AI焦虑拉到极致。

在2024年,以OpenAI为首的大模型公司,真的能打开毁灭人类社会的潘多拉魔盒吗?

01 “AI灭世论”引发焦虑

从上世纪开始,通过图灵测试就成为人类在AI领域为之奋斗的里程碑目标。

可真的有AI通过测试后,人类的惶恐却大过于惊喜。

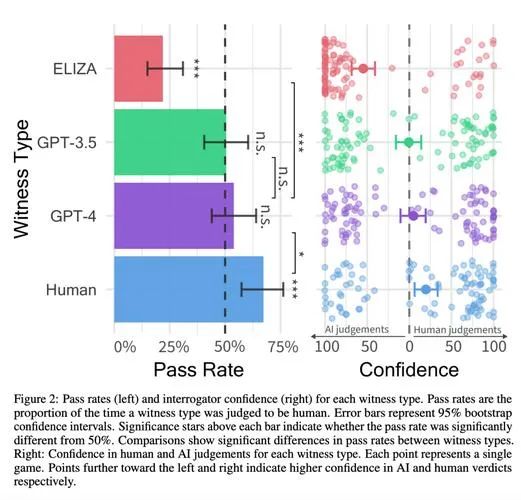

加州大学研究人员招募了500名参与者,让他们与四位“对话者”进行五分钟的交流,这四位“对话者”分别是:真人、上世纪60年代的初代聊天机器人ELIZA、GPT-3.5和GPT-4。

参与者在对话结束后,需判断对方是人还是机器。

评估对象通过率(左) 评估者信任度(右)

结果显示,真人被正确辨认的比例则为67%;ELIZA只有22%;GPT-4和GPT-3.5则高达54%、50%。

这项测试无疑是非常可怕,真人和GPT-4的差距仅有12%!

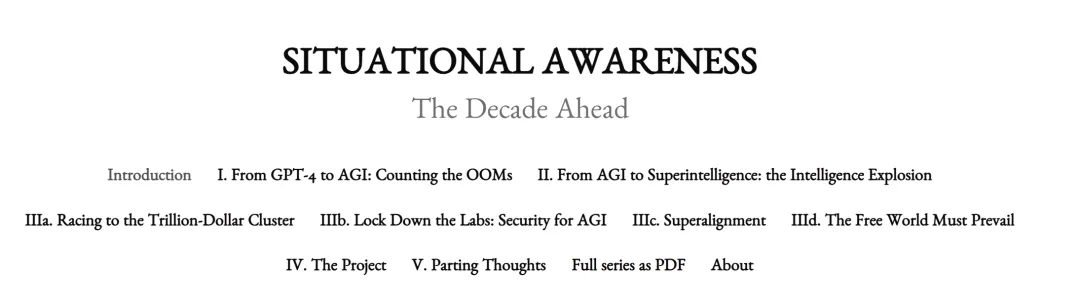

前OpenAI“超级对齐团队”成员利奥波德·阿申布伦纳(Leopold Aschenbrenner),曾在在社交平台披露出来的一份长达165页的PDF文档,对外界发出警告。

阿申布伦纳表示,AI在过去10年深度学习的进步速度非常惊人。仅仅10年前,AI识别简单图像的能力就已经是革命性的。但如今,人类不断尝试提出新颖的、更难的测试,但每个新的基准测试都很快被AI所破解。

过去,破解广泛使用的基准测试,AI需要数十年的时间,而现在只要几个月。

而图灵测试虽然名气大,但从问题深度和难度上,并不如当下最困难的基准测试,也就是类似GPQA的测试,内容是博士级别的生物、化学和物理问题。

阿申布伦纳估计,GPT-4进化到GPT-4o,或者到GPT-5模型迭代后,这一基准测试也将作废。

为什么人类设置的难题,会这么快被AI所破解?原因就是,AI学习能力真的太快了!

来源:利奥波德·阿申布伦纳

2019年发布的GPT-2模型,智力水平仅仅于学龄前儿童相仿,只能简单串起一些看似合理的句子,但是却无法从1数到5,也无法完成总结类任务;

2020年发布的GPT-3模型,智力水平大致达到了小学生的水平,能生成篇幅更长的模型,并能完成一些基础的算术任务和语法纠错;

2022年发布的GPT-4模型,智力水平就能与较为聪明的高中生相似,能编写复杂的代码并进行迭代调试,还能完成高中数学竞赛题。

等到2024年,更先进GPT-4o,更是完成了对GPT-4的全方位超越。

相比较人类,正常人类从小学提升到初中,需要六年的时间;初中提升到高中,又需要三年的事件。

而AI的进化,则是两年一个台阶的越级进化,远远超过正常人类的水平。

02 超级人工智能时代

“在2027年,我们就有极大可能实现AGI(超级人工智能)。”

这是阿申布伦纳的推断,他的数据支撑是GPT-2到GPT-4的模型迭代趋势。

从2019-2022年的4年时间里,ChatGPT算力和算法效率都在以每年0.5个数量级(1个数量级=10倍)的速度发展。

再加上可能出现的释放模型性能的技术突破,等到了2027年,AGI(超级人工智能)时代就会降临,AI工程师完全可以取代人类工程师的所有工作。

AI的“超级进化”,背后是算力与资源的巨额消耗。

AI研究机构Epoch AI评估报告显示,GPT-4训练使用的原始计算量比GPT-2多约3000-10000倍。

这无疑是个可怕的数据,据阿申布伦纳估计,到2027年底,将会出现2个数量级的算力增长,用电量相当于美国一个中小型的州的用电量。

也就是说,要拿一个省份的用电量,来支撑起一个AI大模型的日常训练,这还是GPT-4的水准,还远不到AGI(超级人工智能)的标准。

周鸿祎对阿申布伦纳的言论并不认同,甚至有些“不切实际,更像是科幻小说”。

他表示,如果一个AGI(超级人工智能)的诞生就需要多个省份的电力资源,那么有10个以上的AGI,就能把整个地球的资源抽干殆尽。

周鸿祎给出了自己对AI的担忧,他认为如果在未来诞生出一个AGI,它就会取代人类工程师负责对AI大模型的开发,那么就会有一个24小时日以继夜工作、让算法和技术突破的更快,形成极为夸张的正循环。

在“机器人改造机器人”“机器人改造算法”的模式下,AI的智力水平会从人类进化到超人,那么就会上演“硅基生物VS碳基生物”的好莱坞戏码。

虽然周鸿祎反对阿申布伦纳的言论,但同样认为智能大爆炸之后的“超级智能时代”,将是人类历史上最动荡、最危险、最紧张的时期。

这并不是周鸿祎在社交平台上,第一次对AI领域充斥着忧虑。早在2023年年初,GPT-4刚刚火遍全球的时候,周鸿祎就已经表达过对AI安全的担忧。

周鸿祎表示:原来的人工智能给人的感觉像“人工智障”,虽然能做一些技术比如人脸识别、语音识别,但并不能理解你说的什么。但是ChatGPT模型不仅能够通过图灵试验,而且它有自己的人设、自己的观点,按照进化速度、摩尔定律,如果进一步训练下去,ChatGPT也许就能实现自我意识的突破。

一旦自我意识突破,它就有可能控制全网的电脑,就会认为比人类高明很多。在它眼里,人类这个物种其实无论从存储、算力、反应能力、知识面上比它差太远,它就能反过来奴役人类,科幻正离现实越来越近。

作为360的创始人,AI安全问题,周鸿祎的顾虑更多。

03 无人在意的AI安全

OpenAI作为AI时代的领头羊,面对AI安全的全球舆论,它做了什么吗?

显然是没有的,甚至OpenAI还在今年解散了负责AI安全的“超级对齐团队”。

在去年,OpenAI首席科学家伊利亚·苏斯克沃就因为AI安全问题,对CEO山姆·奥特曼进行弹劾,但最终还是山姆·奥特曼笑到最后,伊利亚·苏斯克沃被赶出公司。

伊利亚·苏斯克沃离开OpenAI后,在6月20日宣布成立新公司SSI(超级安全智能Safe SuperIntelligence)。

最在意AI安全的伊利亚·苏斯克沃离职,上文提到了利奥波德·阿申布伦纳就以“泄密”为由,被OpenAI同样赶出了公司。

这也是他在社交平台发布165页的文档,曝光OpenAI的原因。

甚至,曝光OpenAI的吹哨人,还不止阿申布伦纳一人,在上个月,有一批OpenAI的前员工和现员工联合起来,公开发表了一封联名信,声明OpenAI缺少监管,人工智能系统已经能对人类社会造成严重危害,未来甚至能“灭绝人类”。

虽然“灭绝人类”这个说法过于惊悚,但在解散超级对齐团队之后,OpenAI GPT商店充斥着垃圾邮件,并违反平台的服务条款从YouTube抓取数据。

看到AI安全在OpenAI的地位,越来越多的安全研究人员,选择另谋高就。

艾隆·马斯克也忍不住抨击山姆·奥特曼:“安全并不是OpenAI的首要任务。”

对于外界的批评,山姆·奥特曼置若罔闻,他已经把全部精力用于推动OpenAI彻底转向营利实体,不再由非营利性组织控制。

如果OpenAI转型为营利组织后,有限合伙人每年利润分红的限制就不复存在了,巨额回报激励能够进一步扩大合伙人范围,也有利于OpenAI走向IPO。

也就是说,估值高达860亿美元的OpenAI(约6244亿人民币),将能给山姆·奥特曼本人带来更多的财富。

在Dollar面前,山姆·奥特曼毅然决然的放弃了AI安全。

作者|孙鹏越,编辑|大 风

本文由人人都是产品经理作者【锌财经】,微信公众号:【锌财经】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益